Zur Version ohne Bilder

freiesMagazin Februar 2015

(ISSN 1867-7991)

Fedora 21

Kurz vor Weihnachten und dem Jahresende 2014 ist mit vierwöchiger Verspätung Fedora 21 erschienen. In diesem Artikel sollen die Neuerungen dieser Ausgabe erkundet werden. Dabei wird vor allem auf die GNOME- und KDE-Version von Fedora 21 eingegangen, es werden aber auch die neuen Varianten erklärt, die mit Fedora 21 das erste Mal veröffentlicht wurden. (weiterlesen)

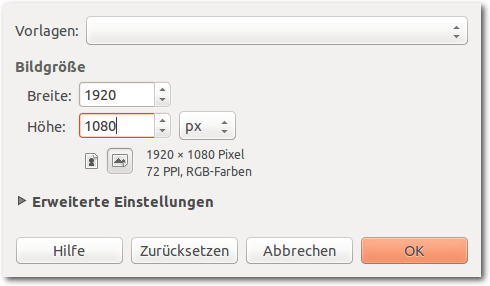

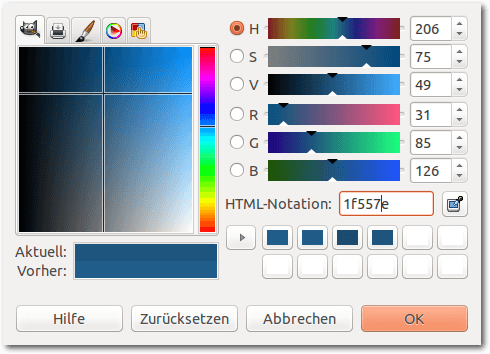

Bildbearbeitung mit GIMP – Teil 2: Helligkeit und Kontrast anpassen

Auch bei guten Bildern besteht oft der Bedarf, die Helligkeit des Bildes zu verändern. Manchmal ist das gesamte Bild zu dunkel oder es sieht etwas „grau“ aus, weil die dunklen Bereiche nicht vollständig schwarz erscheinen. Genau für diese Art von Manipulationen wurden Bildbearbeitungsprogramme wie GIMP entwickelt. Sie verfügen daher über entsprechend viele Werkzeuge, mit denen diese Aufgaben erfüllt werden können. Der zweite Teil der GIMP-Reihe zeigt, wie man Helligkeit und Kontrast bei Bildern anpassen kann. (weiterlesen)

Octave – Teil 2: Funktionen, Graphen und komplexe Zahlen

Nachdem im ersten Teil die Grundfunktionen von Octave (siehe freiesMagazin 12/2014) beschrieben wurden, geht es im zweiten Teil der Reihe direkt mit praktischen Anwendungen weiter. Der Schwerpunkt liegt dieses Mal auf Funktionen und dem Plotten von Graphen in Octave. (weiterlesen)

Zum Inhaltsverzeichnis

Linux allgemein

Fedora 21

Der Januar im Kernelrückblick

Anleitungen

Bildbearbeitung mit GIMP – Teil 2

Git Tutorium – Teil 3

Octave – Teil 2

Kurztipp: Hintergrund einer Blaupause mit GIMP

Software

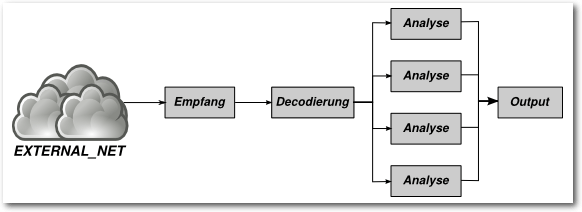

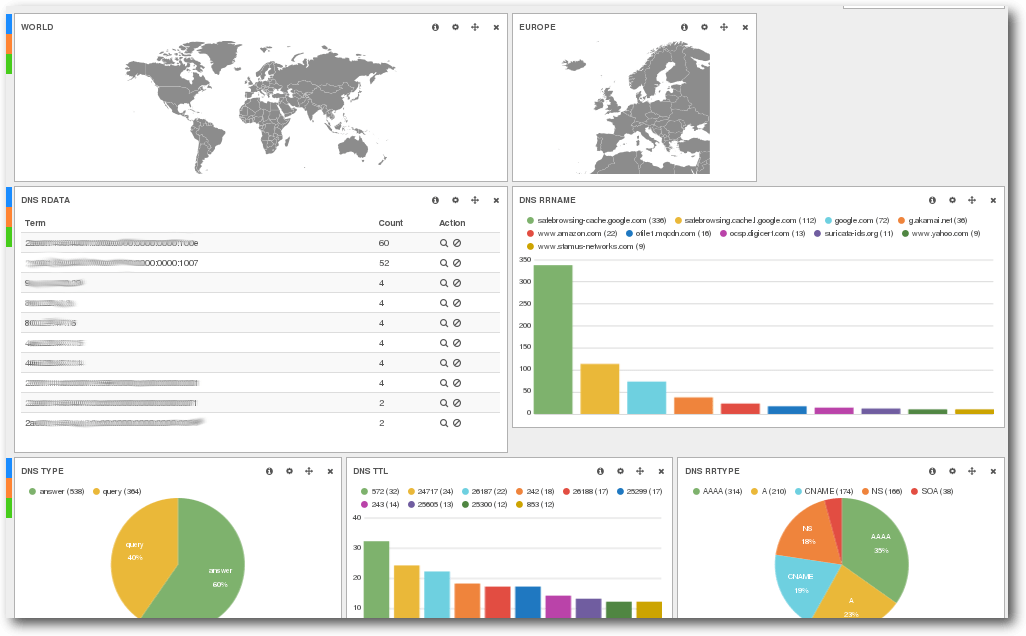

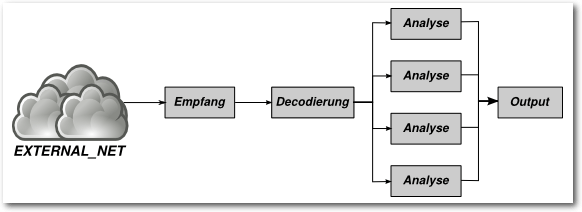

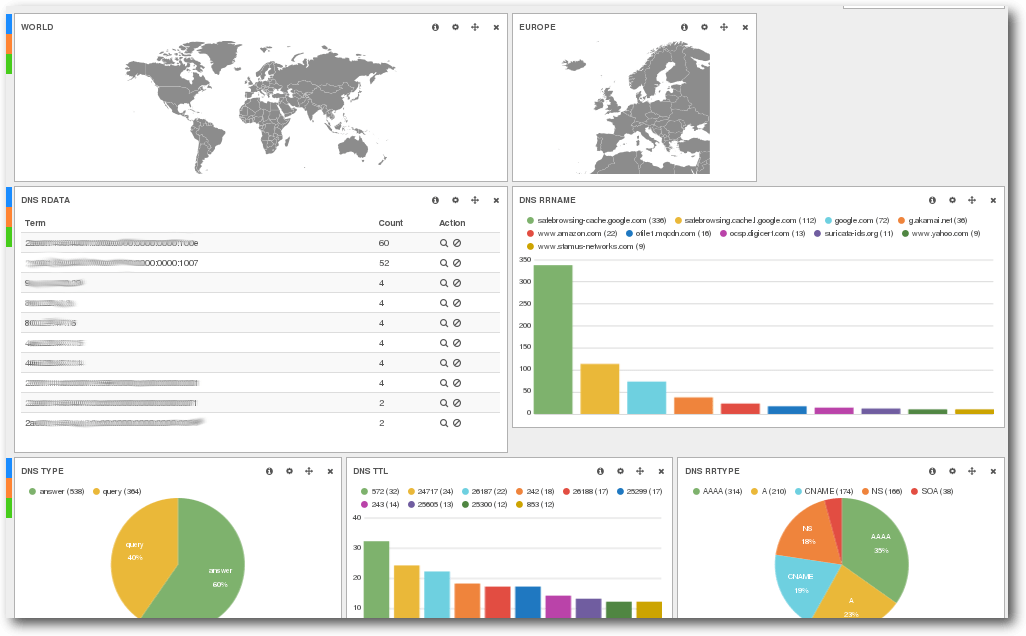

Suricata: Einbruchserkennung mit dem Erdmännchen

Community

Rezension: Praxisbuch Ubuntu Server 14.04 LTS

Rezension: Python – kurz & gut

Rezension: Einführung in Mathematica

Magazin

Editorial

Ende des siebten Programmierwettbewerbs

Leserbriefe

Veranstaltungen

Vorschau

Konventionen

Impressum

Zum Inhaltsverzeichnis

User Liberation bei der FSF

Mit einem Video hat die Free Software Foundation ihren 30-jährigen

Geburtstag eingeleitet, der 2015 ansteht. In dem Video wird auf die

Befreiung der Nutzer durch Freie Software hingewiesen und die Vorteile von

Quellcode-Zugriff angesprochen, sodass eine Untersuchung, Verbesserung und

Verteilung der Software möglich

ist [1].

Der

Verschluss von Quellcode birgt eine gewisse Unsicherheit und auch

externe Kontrolle, der man sich nicht entziehen kann.

Daneben gibt es auch neue FSF-Badges, die jeder unter CC-Lizenz nutzen

kann [2].

Herzlichen Glückwunsch zum 30-jährigen Bestehen wünscht freiesMagazin!

Free Software. Free society. © FSF (CC-BY 4.0)

Galileo Press heißt nun Rheinwerk Verlag

freiesMagazin wird von zahlreichen Verlagen unterstützt, die uns Rezensionsexemplare

zur Verfügung stellen, sodass wir damit das Magazin füllen und Leser

informieren können. Einer dieser Verlage war bisher Galileo Press. Sie haben

zahlreiche Bücher zu Linux-Themen im Angebot, wie man beinahe jeden Monat

dem Magazin entnehmen kann, und unterstützen die Community, wann immer es

möglich ist (z. B. durch Buchpreise und -spenden).

Aus markenrechtlichen Gründen musste sich der Verlag umbenennen und heißt

nun Rheinwerk Verlag [3].

Ansonsten ändert sich aber nichts, die Qualität der Bücher bleibt sicherlich

auch in Zukunft gleich hoch und ebenso wird der Kontakt sehr freundlich und

herzlich bleiben.

An dieser Stelle wollen wir grundsätzlich einmal allen Mitarbeitern der

Buchverlage danken, mit denen wir seit vielen Jahr in sehr gutem Kontakt

stehen, sodass sogar manchmal Weihnachtskarten bei unserem Chefredakteur

eintrudeln. Einen herzlichen Dank an Frau Behrens vom Rheinwerk Verlag, Frau

Robels vom mitp-Verlag, Frau Pahrmann und Frau Bilstein vom O'Reilly Verlag sowie

Frau Markgraf und Frau Rothe vom Carl Hanser Verlag.

Wir wünschen allen Lesern viel Spaß mit der neuen Ausgabe

Ihre freiesMagazin-Redaktion

Links

[1] https://www.fsf.org/blogs/community/user-liberation-watch-and-share-our-new-video

[2] https://www.fsf.org/resources/badges

[3] https://www.rheinwerk-verlag.de/umbenennung/

Beitrag teilen Beitrag kommentieren

Zum Inhaltsverzeichnis

von Hans-Joachim Baader

Kurz vor Weihnachten und dem Jahresende 2014 ist mit vierwöchiger Verspätung

Fedora 21 erschienen. In diesem Artikel sollen die Neuerungen dieser Ausgabe

erkundet werden.

Redaktioneller Hinweis: Der Artikel „Fedora 21“ erschien erstmals bei

Pro-Linux [1].

Ein neues Konzept

Alles ist anders in Fedora 21. Ein volles statt dem üblichen halben Jahr

ließ sich das Fedora-Team Zeit, um den Nachfolger von Fedora 20 (siehe

freiesMagazin 02/2014 [2])

zu schaffen. Die Entwickler hatten diese Pause in Kauf genommen, um die

Distribution grundlegend neu zu strukturieren. Die verlängerte

Entwicklungszeit führte auch zu einer längeren Dauer der Unterstützung für

Fedora 20 (und Fedora 19, dessen Lebensdauer aber nun beendet ist).

Die Überlegung für das sogenannte

Fedora.next [3] war, dass eine

einzelne Variante einer Distribution nicht alle Einsatzbereiche optimal

abdecken kann. Als wesentliche Einsatzbereiche wurden in der Folge Cloud,

Server und Workstation identifiziert, und das sind die drei Varianten, in

denen Fedora künftig erscheint. Die Fedora Spins, abgeleitete Distributionen

für spezielle Einsatzzwecke oder spezifische Vorauswahl von Paketen, beruhen

auf einem dieser Produkte und bleiben im Wesentlichen erhalten. Eine

weitere

Variante ist ein „Atomic-Server“, der nur eine minimale Auswahl von Paketen

mitbringt und der mithilfe von rpm-ostree erstellt wurde. Das im

April

gestartete Projekt Atomic [4] hat das Ziel, eine

Server-Umgebung zu schaffen, die speziell für den Einsatz von Docker

optimiert ist.

Willkommensbildschirm der Live-DVD von Fedora 21.

Überblick

Von den drei „Produkten“ soll nur die Workstation im Rahmen dieses Artikels

behandelt werden. Es gibt allerdings auch interessante

Neuerungen [5] in den

anderen Varianten von Fedora 21. Die Cloud-Version bringt Images, die sowohl

in privaten als auch in öffentlichen Clouds nutzbar sind. Durch die

Aufteilung der Kernel-Module in ein kleines Paket, das auf die wenigen in

der Cloud benötigten Treiber reduziert wurde, und ein Paket mit all den

weiteren Treibern konnten die Images gegenüber Fedora 20 um 25% verkleinert

werden.

Fedora Server bringt zahlreiche neue Verwaltungswerkzeuge wie das

webbasierte universelle Cockpit, Rolekit und OpenLMI. Der Server kann in

eine Domain Controller-Rolle schlüpfen und bringt die integrierte

Identitäts- und Authentifikationslösung FreeIPA [6]

mit.

Die gemeinsame Basis der drei Varianten von Fedora 21 sind die grundlegenden

Pakete, vom Linux-Kernel 3.17 über das Installationsprogramm Anaconda,

Systemd, RPM und einige mehr, die für sich allein aber noch keine benutzbare

Distribution ergeben, sondern durch weitere Pakete ergänzt werden müssen.

Der Vorteil dieser Basis

ist, dass sie

vergleichsweise klein ist und kaum

Änderungen unterliegt. Das macht sie zu einer stabilen Plattform, auf die

andere Initiativen aufbauen können.

Die Desktop-Edition Fedora Workstation bringt die Desktop-Umgebung GNOME in

Version 3.14.

Andere Desktops stehen als „Spins“ zur Verfügung, darunter

MATE 1.8 und das aktuelle KDE SC 4.14 mit den Bibliotheken des KDE

Frameworks 5. Als weitere Desktopumgebungen stehen unter anderem Xfce 4.10,

Cinnamon 2.4, LXDE und Sugar 0.102 zur Verfügung. Enlightenment ist immer

noch in Version E17 mit dabei. GNOME 3.14 lässt sich fast ohne merkliche

Einschränkungen mit Wayland verwenden, das als Technologievorschau dabei

ist. Allerdings bleibt X11 noch bis mindestens Fedora 22 der Standard.

Die Installation der Desktop-Edition soll besonders einfach vor sich gehen

und im Wesentlichen nur aus der Festlegung der Partitionierung bestehen. Da

Installationen von USB-Flash-Medien wesentlich komfortabler sind, haben die

Entwickler auch ein neues Programm geschaffen, welches das Installations-Image

nach dem Download ganz einfach auf das USB-Medium bringt.

Einige neue Funktionen von Systemd 215 kommen ebenfalls zum Einsatz. So

bietet jede Service-Datei zwei Schalter, welche die Sicherheit erhöhen können.

Mit PrivateDevices=yes/no und PrivateNetwork=yes/no kann der Zugang

zum Netz und der zu /dev nach Bedarf geregelt werden. Zudem kann das

Journal dahin gehend konfiguriert werden, dass es Logs im Format von

journald an andere Rechner ausliefert. Weitere Neuerungen von Systemd

verbessern die Verwaltung von Docker-Containern.

Weitere Aktualisierungen sind Make 4.0, Mono 3.4, PHP 5.6, Python 3.4, Ruby

on Rails 4.1 und RPM 4.12.

Installation

Fedora Workstation kann von Live-Images (für DVD oder USB-Stick) oder

minimalen Bootmedien installiert werden. Die Installation erfordert

mindestens 786 MB RAM, wie schon in Version 20. Mit weniger als 768 MB ist

die Installation noch mit Einschränkungen möglich. Für den Betrieb werden

mehr als 1 GB empfohlen.

Die Installation hat sich gegenüber Fedora 20 kaum geändert und kann daher

kurz abgehandelt werden. Sie beginnt mit der Sprachauswahl, bei der

interessanterweise Deutsch als Voreinstellung angeboten wird. Woher der

Installer diese Vorauswahl bezieht, bleibt unklar – vielleicht über

irgendeine BIOS-Einstellung.

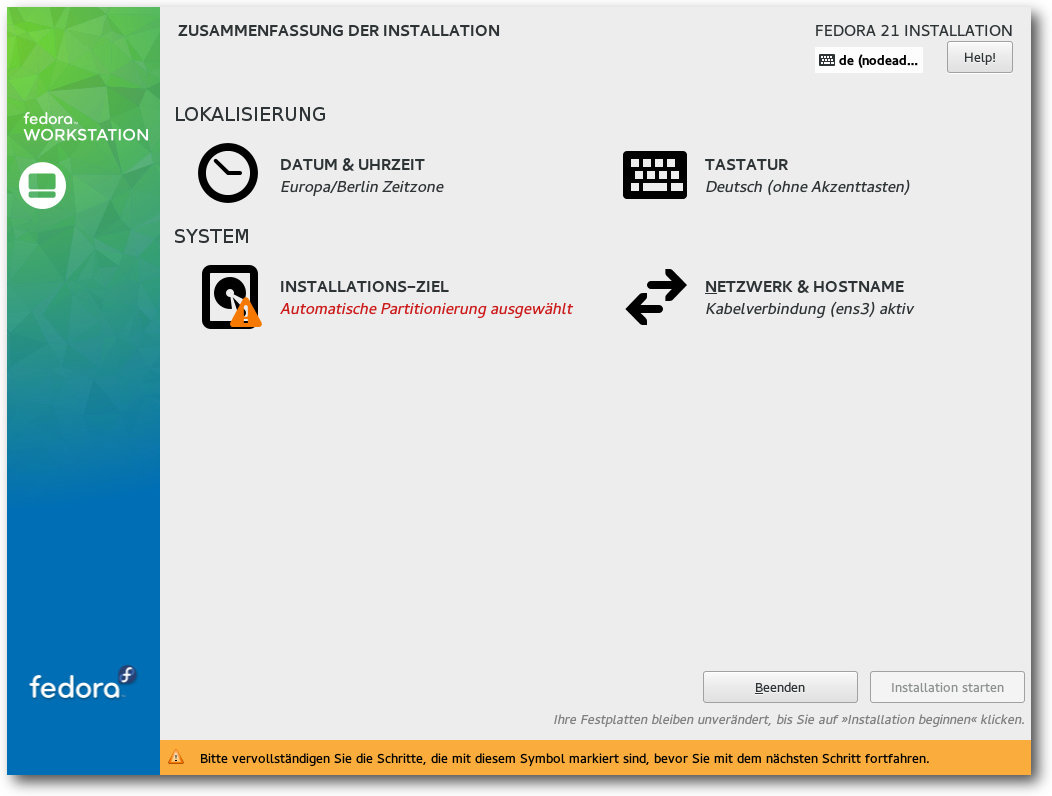

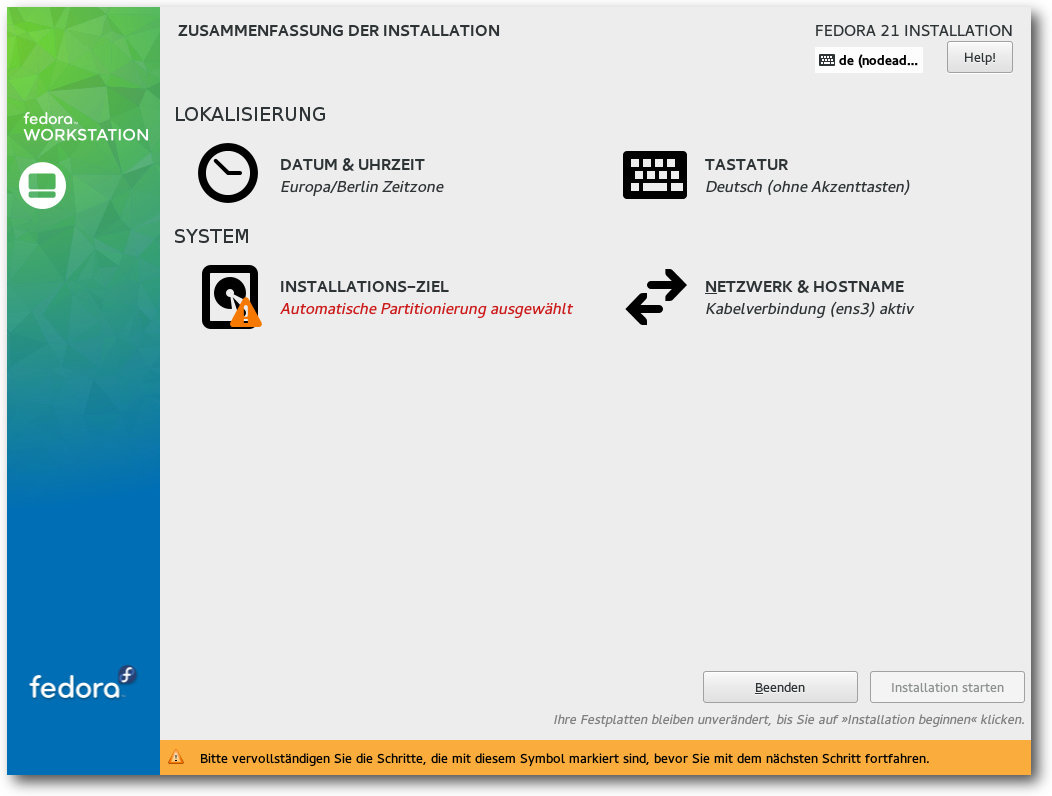

Danach gelangt man zur Übersichtsseite. Hier ermittelt das

Installationsprogramm im Hintergrund bereits einige Dinge, es steht einem

aber frei, diese abzuändern, und zwar weitgehend in beliebiger Reihenfolge.

Alle Punkte, die vom Benutzer zwingend noch bearbeitet werden müssen, sind

mit einem gelben Warndreieck markiert. Die einzige zwingende Aktion ist die

Auswahl des Installationsziels. Die erkannten Festplatten werden durch ein

Icon angezeigt.

Zu empfehlen ist noch die Auswahl der Tastaturbelegung. Hinter diesem Icon

stehen alle Optionen zur Verfügung, einschließlich ungewöhnlicher Belegungen

und Feineinstellungen. Auch die Software-Auswahl sollte man sich noch

ansehen, wenn man nicht GNOME, sondern eine andere Oberfläche installieren

will.

Bei der Partitionierung sind die gewohnten Optionen wie die Verschlüsselung

der gesamten Festplatte oder einzelner Partitionen, RAID und LVM vorhanden.

Auch das Dateisystem Btrfs wird unterstützt, einschließlich seiner

spezifischer Funktionen wie Subvolumes. Btrfs wird anscheinend nicht mehr

als experimentell angesehen und ist eine der möglichen Optionen, wenn man

die automatische Partitionierung wählt. Außer Btrfs sind auch „normale“

Partitionen und eine LVM-Installation möglich, letztere ist die

Standardeinstellung. LVM- und Btrfs-Installation legen eine 500 MB große

/boot-Partition mit dem Dateisystem ext4 an. Bei LVM wird der Rest als

Root-Partition verwendet, mit btrfs wird eine separate /home-Partition

angelegt, die sich aber aufgrund der besonderen Eigenschaften von Btrfs den

Plattenplatz mit der Root-Partition teilt. Im Endeffekt ist diese Lösung

noch flexibler als LVM.

Während die Installation dann im Hintergrund läuft, muss man das

Root-Passwort setzen und kann optional auch Benutzer anlegen. Nach der

Installation ist keine weitere Konfiguration erforderlich, es startet direkt

der Login-Manager, der die ausgewählte Desktopumgebung startet.

Installation von Fedora 21: Übersicht.

Allgemeines Verhalten

Fedora 21 startet etwa genauso schnell wie sein Vorgänger. Wie immer ist

SELinux eingebunden und aktiviert. Als normaler Benutzer merkt man überhaupt

nichts davon, solange die Konfiguration korrekt ist. In Fedora 21 wie auch

in der Vorversion trat kein sichtbares Problem im Zusammenhang mit SELinux

auf. Für den Fall, dass ein Problem auftritt, sei es nach der Installation

von zusätzlicher Software oder anderen Änderungen, steht ein

Diagnosewerkzeug zur Verfügung.

KDE benötigt in Fedora 21 direkt nach dem Start mit einem geöffneten

Terminal-Fenster etwa 328 MB RAM, Gnome dagegen 456 MB, im Classic-Modus 427

MB. Manchmal kommen dazu noch weitere fast 200 MB durch den

PackageKit-Daemon. Normalerweise sollte sich PackageKitd nach fünf Minuten

beenden, wenn er nicht mehr benötigt wird. Doch das funktioniert aus

unerfindlichen Gründen nicht immer. Vermutlich hält irgend etwas, das

periodisch startet, den Daemon am Laufen. Anhand der Cron-Einträge war aber

nicht zu erkennen, was es ist. Das ist auch kein Wunder, da Systemd nun auch

einen teilweisen Ersatz für Cron darstellt und, wie man nach einigem Stöbern

in der Konfiguration sehen kann, auch für den periodischen Start von DNF zur

Aktualisierung des Caches verantwortlich ist. Doch die eigentliche Ursache

für das PackageKitd-Problem war nicht zu finden.

Bei der Geschwindigkeit sollte sich kein nennenswerter Unterschied zwischen

den Desktops feststellen lassen, sofern genug RAM vorhanden ist und die

sonstigen Voraussetzungen erfüllt sind. Die Angaben zum Speicherverbrauch

sind nur als Anhaltswerte zu sehen, die sich je nach Hardware und

Messzeitpunkt erheblich unterscheiden können.

GNOME

GNOME 3.14 ist der Standard-Desktop von Fedora 21. Andere Desktops wie KDE,

Xfce, LXDE oder andere stehen in den Repositorys von Fedora zur Verfügung;

man muss sie entweder explizit anstelle von GNOME wählen oder auf einen der

Fedora-Spins zurückgreifen. Gegenüber GNOME 3.10 in Fedora 20 sind unter

anderem verbesserte Unterstützung für Touch-Gesten und Displays hoher

Auflösung, ein überarbeiteter Dokumentenbetrachter, eine überarbeitete

Wetter-App, die Unterstützung für Google Picture in der Fotoverwaltung Photo

und eine automatische Handhabung für WiFi-Hotspots zu verzeichnen. Außerdem

wurden die mitgelieferten

Programme in vielen Punkten verbessert und

aktualisiert. GNOME unterstützt jetzt Wayland weitgehend, was sich mit

Fedora 21 auch testen lässt. Da es Wayland noch an grundlegenden Vorteilen

gegenüber X fehlt, soll auf eine Betrachtung an dieser Stelle verzichtet

werden. Das Theme

Adwaita wurde vollständig neu geschrieben und bietet jetzt

neue Menüleisten, animierte Schalter, verbesserte Benachrichtigungsdialoge

und überarbeitete Spinner-Animationen. Der Gebrauch von Animationen wurde

generell verstärkt.

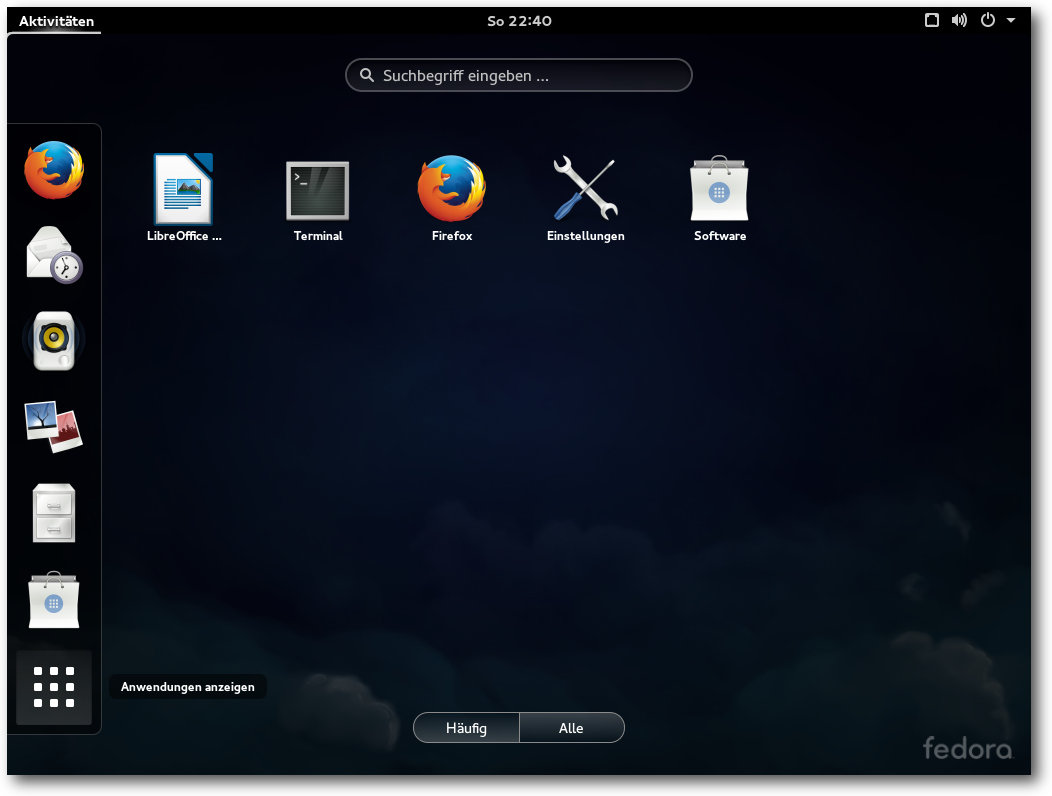

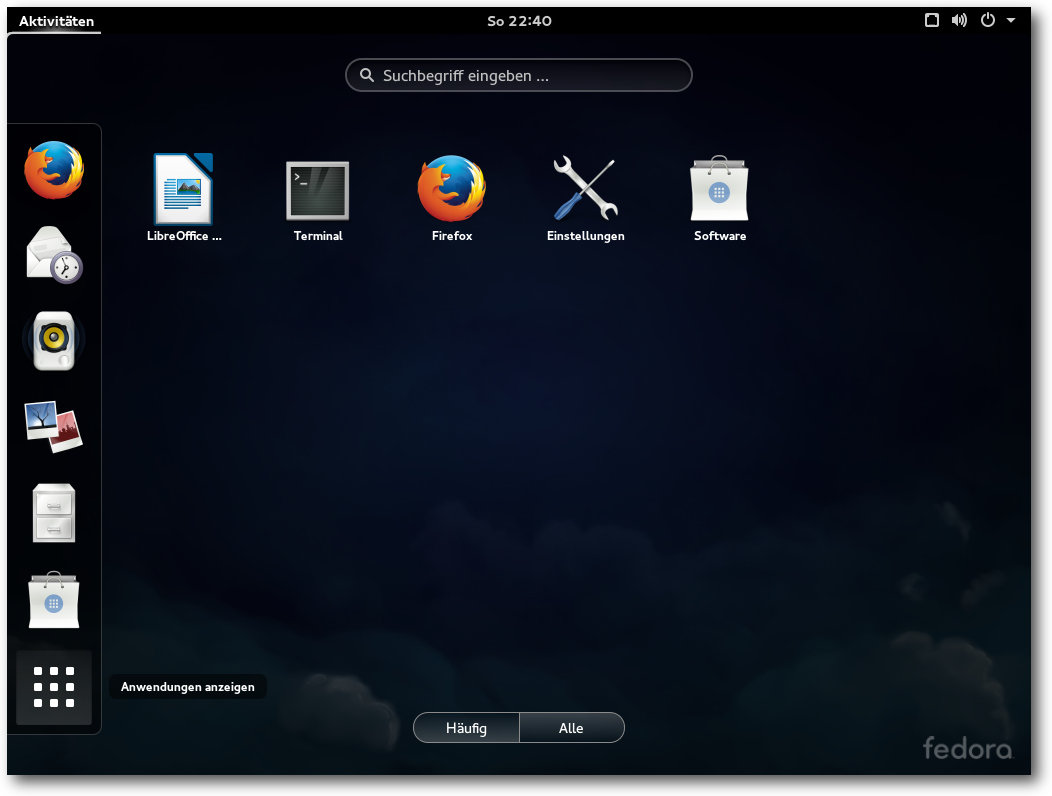

Übersichtsseite von GNOME.

Beim ersten Start von GNOME wird das Programm „Gnome Initial Setup“

gestartet, das das Setzen einiger Optionen und die Eingabe von Online-Konten

ermöglicht. Alle Schritte können auch übersprungen und später ausgeführt

werden.

Der GNOME Login-Manager hat drei Sitzungen vordefiniert, wobei das

Standard-GNOME die Voreinstellung ist. Die zweite Option ist GNOME Classic,

die dritte ist GNOME unter Wayland. Wer das ausprobieren möchte, benötigt

wahrscheinlich eine 3D-beschleunigte Grafikkarte von Intel, AMD oder NVIDIA.

Der Standard-Webbrowser unter GNOME ist Firefox 34.0. Außer zwei Plug-ins

sind keine

Erweiterungen vorinstalliert. Dabei handelt es sich um die GNOME

Shell-Integration und den iTunes Application Detector. Die Office-Suite

LibreOffice ist in Version 4.3.4.1 installiert, aber nicht komplett.

Fehlende Komponenten wie z. B. Base muss man bei Bedarf nachinstallieren. Die

GNOME-Shell kann dank Software-Rendering auf jeder Hardware laufen, auch

wenn keine Hardware-3D-Beschleunigung zur Verfügung steht. Das

Software-Rendering ist einigermaßen schnell und durchaus noch benutzbar,

doch wird man es wohl kaum ertragen, wenn man keinen sehr schnellen

Prozessor hat. Die Situation bessert sich mit einem Mehrkern-Prozessor, doch

Videos verzögerungsfrei abzuspielen, ist auf diese Weise schwer. Bei kleinen

Videoformaten kann es aber noch gelingen.

Bedauerlich ist, dass das gnome-tweak-tool, auf Deutsch

Optimierungswerkzeug genannt, nicht standardmäßig installiert ist. Denn man

benötigt es, um Erweiterungen für die GNOME-Shell zu installieren, da dafür

kein Weg in der Standardkonfiguration vorhanden ist. Daneben kann man auch

andere Dinge einstellen, die die GNOME-Entwickler nicht in der GUI

konfigurierbar gemacht haben.

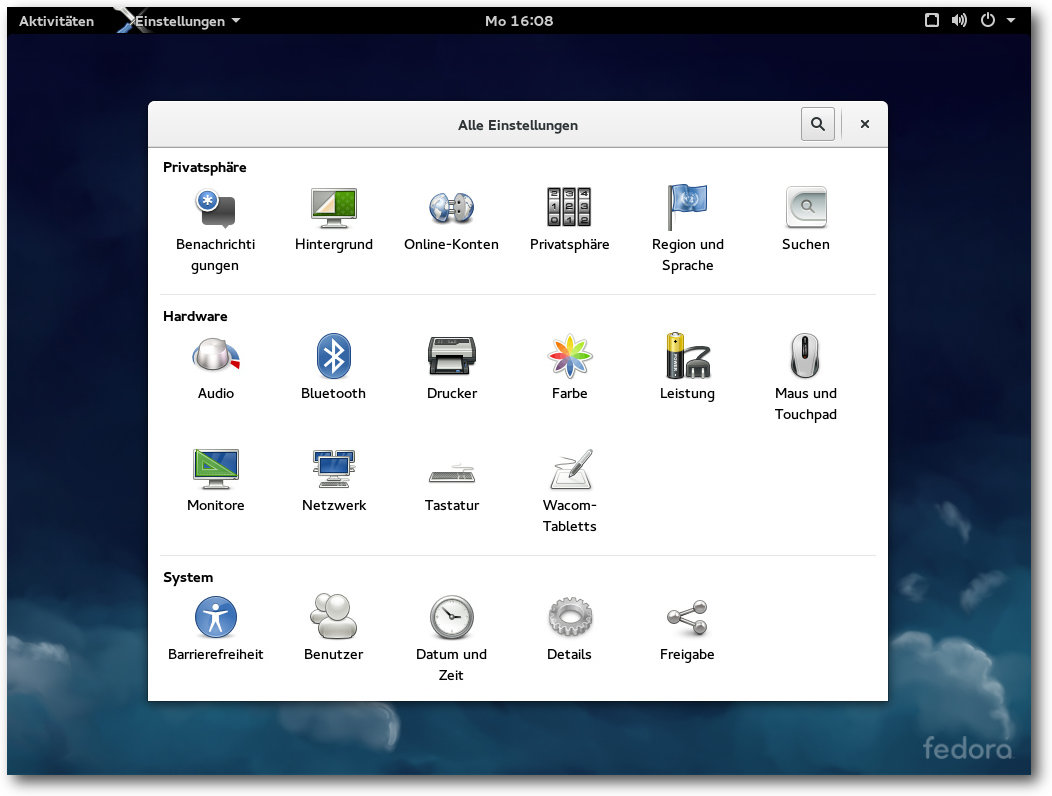

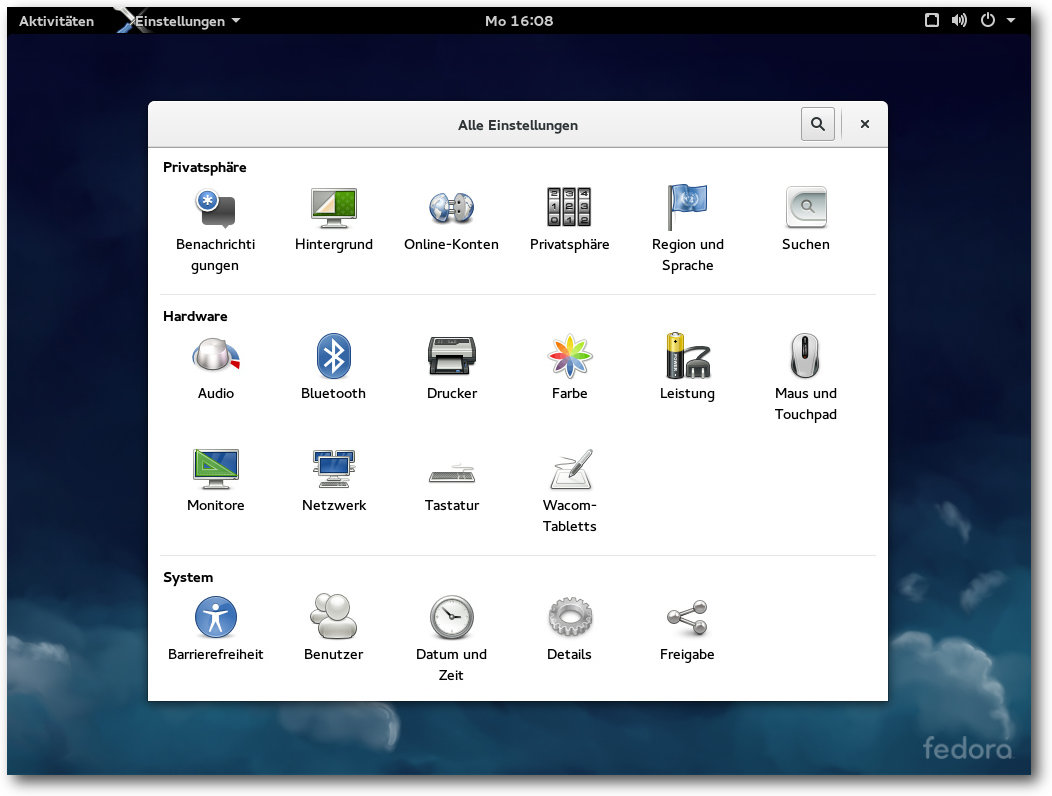

Das ist alles, was GNOME an Einstellungen anbietet.

Neu ist das Werkzeug DevAssistant [7], das

Entwicklern helfen soll, Entwicklungsumgebungen für ihre Projekte

einzurichten, sodass sie sich mehr auf das Schreiben von Code konzentrieren

können. Da Entwickler viel mit Terminals arbeiten, wurde hier zusätzlicher

Komfort eingebaut, unter anderem die Option eines transparenten

Hintergrunds, automatische Aktualisierung des Titels, Umschalter zum

Deaktivieren von Tastenkürzeln und Suche nach Terminals anhand des Namens in

der GNOME-Desktop-Übersicht. Das hat zur Folge, dass das Terminal mehr

Optionen anbietet, als der gesamte GNOME-Desktop. Das mag Entwickler freuen,

normale Benutzer überzeugt man damit aber nicht.

Eine Sitzungsverwaltung fehlt weiterhin. Zwar ist gnome-session in der

Lage, Sitzungen zu speichern und wieder herzustellen, doch die Definition

von Sitzungen ist nur über Konfigurationsdateien oder über das

gnome-tweak-tool möglich. Möglicherweise funktioniert es auch nicht bei

allen Programmen, und die Programme, bei denen es funktioniert, nehmen auch

nicht den Zustand an, den sie zuletzt hatten, sondern werden lediglich

gestartet und mit ihrem Fenster auf die letzte Position gesetzt.

Alle Systemlogs werden über journald verwaltet. Das erfordert weiteres

Umdenken, ist primär aber eine Vereinfachung, da der einfache Aufruf von

journalctl bereits alle Logeinträge anzeigt. Diese kann man dann

durchsuchen, filtern usw. – aber das unter Umständen lästige Suchen in

mehreren Logdateien entfällt, ganz zu schweigen von den weiteren Vorteilen

von Journald, die syslog mit einem Mal so alt aussehen lassen, wie es ist.

Es gibt auch einen grafischen Logbetrachter – gnome-logs (deutscher Name:

Protokolle), der allerdings nicht installiert ist und nur mit Yum oder DNF

nachinstallierbar ist. Er bietet allerdings auch nur einfache

Filtermöglichkeiten und dürfte einem Systemverwalter auf keinen Fall genügen.

KDE

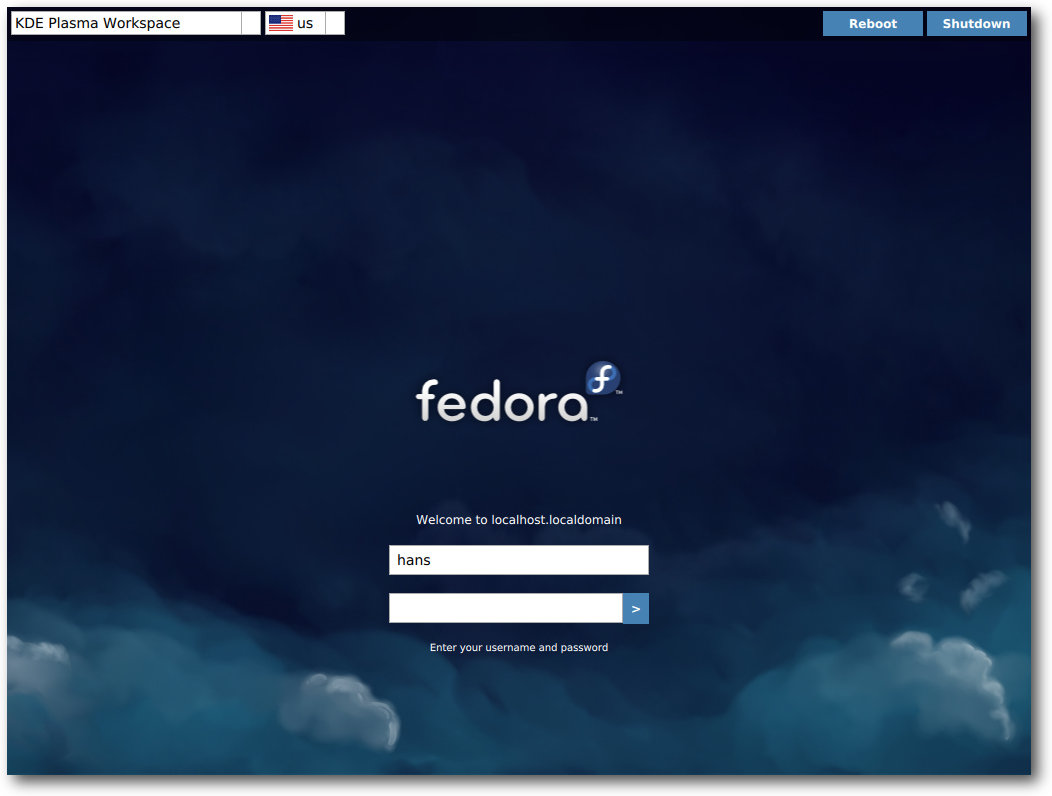

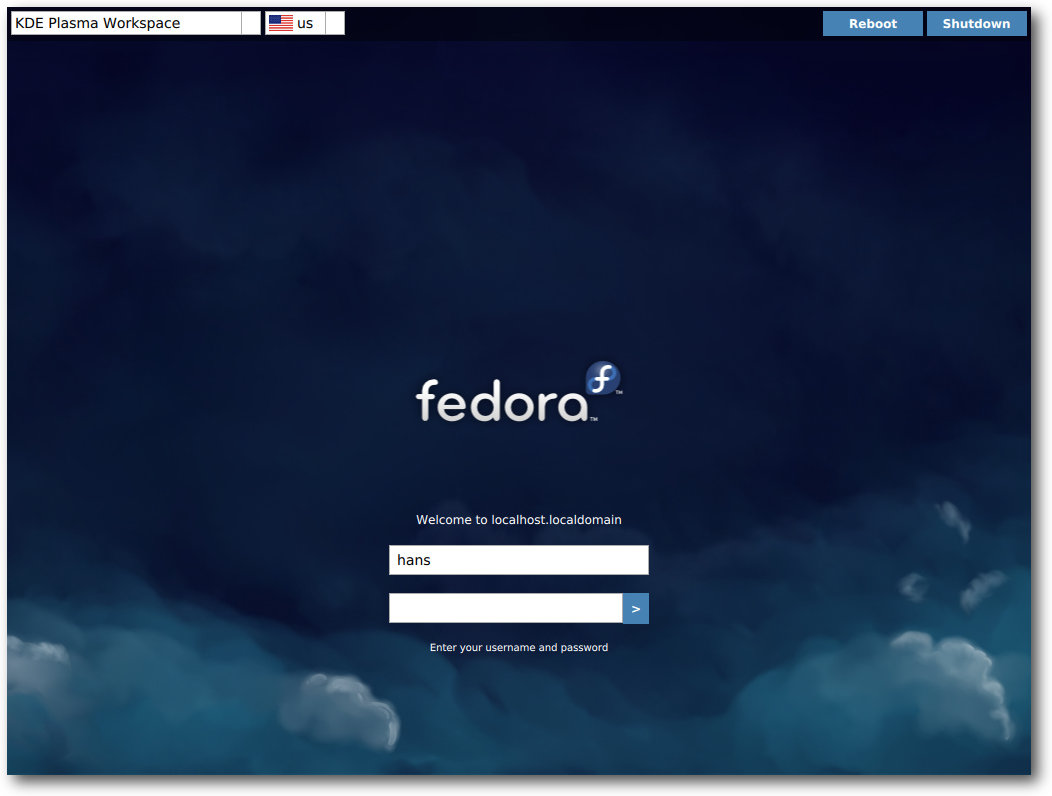

KDE ist in Version 4.14.3 enthalten, aber seit Fedora 18 nur noch ein Spin.

Die Installations-DVD entspricht ungefähr der Workstation-Variante. Beim

ersten Start erscheinen die Texte in einem verqueren Mix aus Englisch und Deutsch, da

offenbar nicht alle Übersetzungen installiert wurden.

Die Anmeldung erfolgt nun mit dem neuen Anmeldemanager SDDM, den man durch

KDM ersetzen kann, wenn man will. Der Standard-Webbrowser ist Konqueror,

augenscheinlich ohne Änderungen an den Standardeinstellungen. Firefox ist

dagegen nicht installiert. Ebenso fehlt LibreOffice, stattdessen ist die

Calligra-Suite installiert. Installiert man Firefox nach, so präsentiert

sich dieser ohne Erweiterungen oder Plug-ins.

Login-Bildschirm von KDE.

KDE ist weiterhin angenehm zu benutzen und im Rahmen des Tests, der

natürlich keine allzu großen Anforderungen stellt, fast problemlos. Im

Gegensatz zu GNOME sind die traditionellen Bedienelemente unbeschädigt

erhalten und es gibt Einstellungsmöglichkeiten bis ins kleinste Detail, ohne

dass man etwas nachinstallieren muss. Die Anwendungen bieten einen großen

Funktionsumfang und sind konfigurier- und erweiterbar. Nicht immer ist

allerdings die Auswahl der mitgelieferten Anwendungen sinnvoll. Der

Video-Player wird weiter unten noch erwähnt, aber auch Calligra scheint

längst nicht so stabil zu sein, wie es sollte. Beim Schließen einer langen

(MS Word-)Datei stürzte Calligra Words ab, obwohl nichts an der Datei

geändert wurde.

Der KDE-Spin nutzt noch nicht den Journald von Systemd für das Loggen,

sondern installiert und startet weiterhin rsyslog. Die Bibliotheken des KDE

Frameworks 5 sind vorhanden, sodass man Programme für die nächste

Generation von KDE entwickeln, aber auch ablaufen lassen kann. Der Name der

entsprechenden Pakete, die nicht vorinstalliert sind, beginnt mit kf5-.

Multimedia im Browser und auf dem Desktop

Wegen der Softwarepatente in den USA kann Fedora, ebenso wie die meisten

anderen Distributionen, nur wenige Medienformate abspielen, da es viele

benötigte Codecs nicht mitliefern kann. Die Lösung heißt wie immer RPM

Fusion [8]. Diese Seite bietet zusätzliche

Repositorys, die man leicht hinzufügen kann. Dies gilt für alle Desktops

gleichermaßen. Die Installation funktioniert prinzipiell mit Konqueror und

Firefox. Während unter GNOME die Installation reibungslos klappte, lieferten

unter KDE sowohl Konqueror als auch Firefox am Ende eine Fehlermeldung, dass

Apper ein Paket nicht finden konnte. Trotz dieser Meldung, die für Benutzer

so aussieht, als wäre die Installation fehlgeschlagen, war aber alles

installiert. Das kann eigentlich nur ein, möglicherweise neuer, Fehler in

Apper sein.

Die meisten Player bieten bekanntlich die Option an, über die

Paketverwaltung nach passenden Plug-ins zu suchen. Das funktioniert jetzt

endlich, der einzige Mangel ist, dass man meist die Anwendung neu starten

muss, nachdem ein Plug-in

installiert wurde. Wer sich auskennt, kann auch

alle benötigten Codec-Pakete von Hand installieren. Sie sind sämtlich in

Form von GStreamer-Plug-ins von RPM Fusion zu beziehen. Da sowohl die neue

Version 1.4 von GStreamer als auch die Version 0.10 noch in Gebrauch sind,

installiert man am besten die Codec-Sammlungen plugins-bad und

plugins-ugly in allen Varianten für GStreamer 0.10 und GStreamer 1.4. Für

GStreamer 0.10 benötigt man außerdem und vor allem das FFmpeg-Plug-in, für

GStreamer 1.4 dessen Fork libav.

Der Standard-Player für Audio und Video ist unter GNOME der Player „Videos“,

früher Totem genannt. Unter KDE sind es Amarok und Dragonplayer. Während

Amarok funktionierte, gab es bei Videos mit Dragonplayer wiederum Probleme.

Der Ton war da, das Bild aber nicht. Es bleibt dabei, dass Dragonplayer zu

Nichts zu gebrauchen ist. Man installiert stattdessen besser bewährte

Programme wie (S)MPlayer, VLC oder Xine, die auch viel mehr Funktionalität

aufweisen.

Anders als in Ubuntu wird unter Fedora das von Cisco finanzierte

OpenH264-Plugin, das ein freier Ersatz für das Adobe Flash-Plugin ist, nicht

automatisch heruntergeladen. Die Gründe

dafür [9] sind, dass der

Binärcode des Plug-ins nicht in der Fedora-Infrastruktur kompiliert wurde,

was die Paketrichtlinien verletzt, dass die Cisco-Lizenz den Benutzern nicht

angezeigt werden konnte

und dass

die Cisco-Lizenz kommerzielle Nutzungen des Plug-ins verbietet, was die

Fedora-Richtlinien verletzt. Man muss das Plug-in daher manuell

herunterladen, falls man es nutzen will [10].

Nötig ist das aber in vielen Fällen nicht. Auch ohne Flash-Plug-in kommt

Firefox in Fedora mit Flash-Videos klar, da der Browser mit

GStreamer-Unterstützung kompiliert wurde und damit das ffmpeg-Plug-in nutzen

kann. Getestete Seiten, die so funktionieren, sind unter anderem YouTube,

Vimeo, Tagesschau.de und Heute.de.

Paketverwaltung und Updates

Der Software-Installer ist seit Fedora 20 das Zentrum für Anwender, die

zusätzliche Pakete für ihr System suchen. Das Programm wurde in dieser

Version schneller und benutzerfreundlicher und bietet eine stark vergrößerte

Paketauswahl an. Es ähnelt dem Software Center von Ubuntu, besitzt

allerdings deutlich weniger Funktionalität. Für eine ernsthafte

Systemverwaltung mit yum und RPM ist es kein Ersatz.

Unter KDE kommt weiterhin Apper zum Einsatz, jetzt in Version 0.9.1. Apper

ist im Gegensatz zu „Gnome-Software“ eine vollständige Paketverwaltung mit

Paketquellen, Updates und Details bis auf die Paketebene. Sie kann die

Kommandozeilenprogramme vollständig ersetzen, hat aber in der neuen Version

offenbar einige neue Macken bekommen. Neben dem bereits erwähnten Phänomen

funktionieren auch die Paketgruppen, die im Apper-Hauptbildschirm offeriert

werden, nicht. Das Backend unterstütze die Operation „SearchGroups“ nicht,

lautet die Meldung.

Die gesamte Paketverwaltung baut unter GNOME und KDE grundsätzlich auf

PackageKit auf. Sie funktioniert normalerweise reibungslos und die Updates,

wenn sie auch zahlreich sind, sind dank Delta-RPMs oft erstaunlich klein und

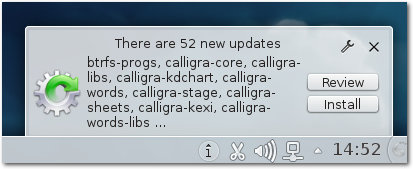

schnell installiert. Neu verfügbare Updates werden im

Benachrichtigungsbereich angezeigt.

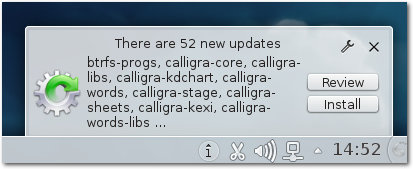

Update-Benachrichtigung in KDE.

DNF, ein möglicher und teilweise schnellerer Ersatz für Yum, wurde von

Version 0.4.10 auf 0.6.3 aktualisiert. Wie schon in Fedora 20 wird DNF

parallel zu Yum installiert. Obwohl DNF nach Ansicht seiner Entwickler

längst dieselbe Funktionalität wie Yum aufweist und bei einigen Operationen

deutlich schneller als Yum ist, ist letzteres immer noch der Standard an der

Kommandozeile. Das soll sich ändern, in Fedora 22 soll DNF 1.0 Yum

ersetzen [11].

Neu in Fedora 21

Einige weitere Neuerungen lassen sich den Anmerkungen zur

Veröffentlichung [5]

entnehmen. Die Firewall in Fedora Workstation wurde „entwicklerfreundlicher“

gemacht, wie es die Entwickler ausdrücken. Ports unter 1024 sind aus

Sicherheitsgründen mit Ausnahme des SSH-Ports und Client-Ports für Samba und

DHCPv6 blockiert.

Die Ports darüber sind jetzt aber standardmäßig offen. Das

bringt nach Ansicht der Entwickler keine Sicherheitsprobleme, da auf diesen

Ports normalerweise nichts nach außen lauscht. Trotzdem war die Änderung

umstritten, denn die Nachinstallation eines Pakets könnte einen Dienst

starten, der unbeabsichtigt von außen zugänglich ist. Selbstverständlich

lässt sich das Verhalten aber ändern, Näheres findet man im

Wiki [12].

NetworkManager kann nun mit Portalen umgehen, die Anfragen der Benutzer

umleiten, um beispielsweise erst einmal ein kostenpflichtiges Log-in zu

erzwingen. Man kann NetworkManager aber auch anweisen, die Behandlung dem

Benutzer zu überlassen.

Interessant sind für die Benutzer die zahlreichen Anwendungen, die Fedora in

den Repositorys bereithält. Besonders sind dieses Mal Entwicklerwerkzeuge zu

nennen. So wurde die Unterstützung für OpenCL verbessert und pocl

aufgenommen. Es gab Updates von Ruby und Tcl/Tk und

Erweiterungen der

Scala-Entwicklungsumgebung. Für Java wird nicht nur das aktuelle Eclipse

Luna angeboten, sondern OpenJDK 8 ist jetzt der Standard-Java-Compiler.

Jenkins ist neu mit dabei und ReviewBoard wurde auf Version 2.0

aktualisiert. Außerdem wurde die Toolbox Shogun für maschinelles Lernen

aufgenommen.

Fazit

Fedora 21 weist überraschend wenig Veränderungen gegenüber dem Vorgänger

auf, wenn man bedenkt, dass doppelt so viel Zeit vergangen ist wie üblich

und das Fedora-Projekt tiefgreifende organisatorische Änderungen vornahm. In

der Workstation-Distribution ist davon eigentlich nichts zu spüren. Die

Entwicklung verlief kontinuierlich. Wie üblich gab es aber eine große Zahl

von neuen Paketen und Aktualisierungen.

So bleibt Fedora 21 Workstation eine Distribution von hoher Qualität, bei

der es kaum etwas zu beanstanden gibt. Hat man erst einmal den ersten

Schritt, die eigentliche Installation, gemeistert, geht es nur noch um

Erweiterungen oder die Anpassung an die eigenen Präferenzen. Das ist aber

bei jeder Desktop-Distribution der Fall. Fehler können besonders in der

Anfangszeit von Fedora 21 auftreten, sind aber selten gravierend. Zudem

werden viele anfängliche Fehler schnell behoben.

Fedora bringt reichliche und häufige Updates und ist damit immer aktuell.

Doch das ist auch die größte Schwäche der Distribution: Die Basis ändert

sich ständig und es gibt keine Version mit langfristigem Support. Alle sechs

Monate (sofern Fedora zum früheren Zyklus zurückkehrt) ist das Update auf

die neueste Version Pflicht. Damit ist und bleibt Fedora eine der besten

Distributionen für Entwickler und alle Benutzer, die immer die neueste

Software wollen und auch kein Problem mit den Updates haben. Andere Benutzer

sollten sich aber eher bei anderen Distributionen umsehen.

Links

[1] http://www.pro-linux.de/artikel/2/1744/fedora-21.html

[2] http://www.freiesmagazin.de/freiesMagazin-2014-02

[3] https://fedoraproject.org/wiki/Fedora.next

[4] http://projectatomic.io/

[5] http://fedoraproject.org/wiki/Releases/21/ChangeSet

[6] http://www.freeipa.org/

[7] http://devassistant.org/

[8] http://rpmfusion.org/

[9] https://fedorahosted.org/fesco/ticket/1359

[10] https://fedoraproject.org/wiki/OpenH264

[11] http://fedoraproject.org/wiki/Changes/ReplaceYumWithDNF

[12] https://fedoraproject.org/wiki/FirewallD

| Autoreninformation |

| Hans-Joachim Baader (Webseite)

befasst sich seit 1993 mit Linux. 1994 schloss er erfolgreich sein

Informatikstudium ab, machte die Softwareentwicklung zum Beruf

und ist einer der Betreiber von Pro-Linux.de.

|

Beitrag teilen Beitrag kommentieren

Zum Inhaltsverzeichnis

von Mathias Menzer

Basis aller Distributionen ist der Linux-Kernel, der fortwährend

weiterentwickelt wird. Welche Geräte in einem halben Jahr unterstützt werden und

welche Funktionen neu hinzukommen, erfährt man, wenn man den aktuellen

Entwickler-Kernel im Auge behält.

Linux 3.19

So richtig schien die Entwicklung von Linux 3.19 nicht in Schwung zu kommen, was

in erster Linie den Weihnachtsfeiertagen und dem Jahreswechsel geschuldet war.

So konnte es mit dem -rc3 [1] eigentlich nur

vorwärts gehen und das war auch der Fall. Eine

der größten Änderungen war das Entfernen eines Treibers für eine

On-Chip-Netzwerkschnittstelle, der auf eine zuvor bereits entfernte Architektur

angewiesen war. Auch die etwas verkürzte Woche zum Linux

3.19-rc4 [2] verlief sehr ruhig und konnte

neben einem recht niedrigen Grundrauschen an Fehlerkorrekturen lediglich mit

Aufräumarbeiten am Kernel Debugger und den Performance

Counters [3] aufwarten.

Die fünfte Entwicklerversion [4] brachte die

Korrektur für einen Fehler in der Speicherverwaltung der ARM64-Architektur mit.

Dazu kamen weitere Korrekturen

an der ARM-Architektur und den Treibern, wobei das USB-Umfeld mit den größten

Änderungen aufwartete. Je nach Betrachtungsweise fiel Linux

3.19-rc6 [5] dann schon wieder kleiner

aus – die Zahl der Commits ging von über 300 auf 266 zurück, das Volumen der

Änderungen selbst war jedoch leicht höher.

Dave Jones: Jäger des verlorenen Fehlers

Eines der umtriebigsten Gesichter der

Kernel-Entwickler-Gemeinde wechselte im Januar von Red Hat zu

Akamai: Dave Jones. Trotz des Wechsels soll DaveJ weiterhin seine bisherigen Tätigkeiten in der

Kernel-Entwicklung wahrnehmen. Das bedeutet insbesondere, dass er dem Kernel-Code

mittels automatisierter Tests auf den Zahn fühlt und aufgetretene Probleme

analysiert und behebt oder an den Maintainer des jeweiligen Subsystems

weiterreicht.

Gerade in den letzten Monaten machte Jones von sich reden, da er einem besonders

hartnäckigen Fehler auf der Spur war (siehe „der November im Kernel-Rückblick“,

freiesMagazin 12/2014). Im Zuge der

Fehlersuche wurden einige Subsysteme des Kernels verdächtigt und es wurden dort

auch einige Fehler bereinigt, jedoch tauchte das ursprüngliche Problem immer

wieder auf. Zuletzt konnte das Problem von Linus Torvalds reproduziert werden,

indem er direkt auf den für den High Precision Event

Timer reservierten

Speicherbereich schrieb.

Damit scheint die Ursache dieses Problems gefunden. Jones stört sich jedoch noch

an dem Punkt, dass sein Fuzzing-Tool

Trinity [6] eigentlich die

betreffende Speicherstelle gar nicht hätte beschreiben dürfen. Er nennt zwei

mögliche Ursachen, um den Effekt trotzdem erklären zu können: Zum einen könnte

Trinity die Adresse des HPET zufällig erzeugt und an einen Systemaufruf

weiterreichen, der dann an diese Stelle schreibt. Seine zweite, etwas profanere

Erklärung liegt in einem Hardware-Fehler: Jones fand mittlerweile Hinweise

darauf, dass ein CPU-Problem den Zeitgeber aus dem Takt bringen konnte, wenn das

System unter Last gerät. Letzteres wird er jedoch nicht mehr verifizieren

können, da er die Hardware an seinen früheren Arbeitgeber zurückgegeben hat.

Links

[1] https://lkml.org/lkml/2015/1/5/787

[2] https://lkml.org/lkml/2015/1/11/190

[3] https://en.wikipedia.org/wiki/Perf_(Linux)

[4] https://lkml.org/lkml/2015/1/18/32

[5] https://lkml.org/lkml/2015/1/26/1

[6] http://codemonkey.org.uk/projects/trinity/

| Autoreninformation |

| Mathias Menzer (Webseite)

behält die Entwicklung des Linux-Kernels im Blick, um über kommende Funktionen

von Linux auf dem Laufenden zu bleiben. |

Beitrag teilen Beitrag kommentieren

Zum Inhaltsverzeichnis

von Die GIMPer

Auch bei guten Bildern besteht oft der Bedarf, die Helligkeit des Bildes

zu verändern. Manchmal ist das gesamte Bild zu dunkel oder es sieht etwas

„grau“ aus, weil die dunklen Bereiche nicht vollständig schwarz erscheinen.

Genau für diese Art von Manipulationen wurden Bildbearbeitungsprogramme wie

GIMP entwickelt. Sie verfügen daher über entsprechend viele Werkzeuge, mit

denen diese Aufgaben erfüllt werden können. Der zweite Teil der GIMP-Reihe

zeigt, wie man Helligkeit und Kontrast bei Bildern anpassen kann.

Redaktioneller Hinweis: Dieser Text ist ein angepasster Auszug aus dem Buch

„Bildbearbeitung mit GIMP – Die 101 wichtigsten Tipps: Teil 1 – Grundlegende

Funktionen” [1].

Bevor man das geeignete Werkzeug für die Aufgabe der Helligkeitsanpassung

findet, sollte man sich klar machen, worin die Aufgabe genau besteht:

- Geht es darum, einzelne Bildteile oder ganze Bilder einheitlich zu

bearbeiten? Im ersten Fall hat man zwei Möglichkeiten: Man kann die

gewünschten Bildbereiche mit einer Auswahl begrenzen oder man kann mit

feinen Malwerkzeugen die Retusche manuell vornehmen.

- Kennt man vielleicht schon ein Werkzeug oder ein Verfahren, mit dem man

schon gute Erfahrungen bei der aktuellen Aufgabe gemacht hat, oder möchte man

vielleicht etwas Neues ausprobieren?

Ist letzteres der Fall, kommen hier ein paar Empfehlungen:

- Für ganz einfache Fälle kann man auf das Werkzeug „Helligkeit und Kontrast

anpassen“ zurückgreifen. Sind die Ansprüche etwas höher, wird man vermutlich

das Werkzeug „Werte“ vorziehen.

- Bei Bildern, die insgesamt zu dunkel (oder hell) sind, liefert die

„Ebenenmodimethode“ oft gute Ergebnisse.

- Sind die Helligkeiten insgesamt unglücklich verteilt, sollte man sein

Glück mit dem Kurvenwerkzeug versuchen.

- Manchmal wirkt auch eine Kontrastmaske wahre Wunder und klart das

gesamte Bild auf.

- Bei feinen Retuschen sind verschiedene Malwerkzeuge oft unschlagbar.

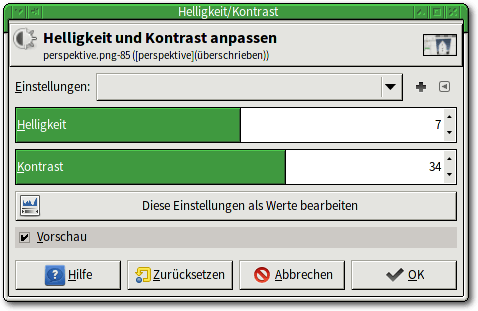

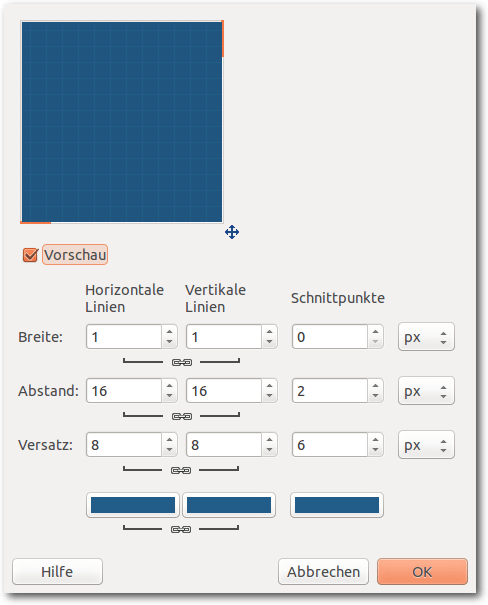

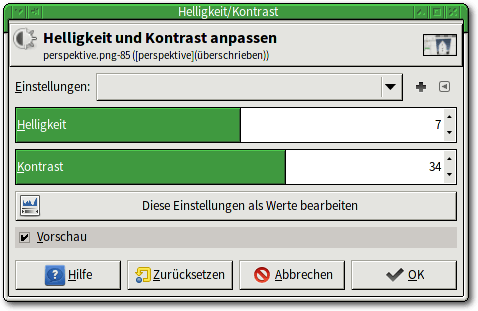

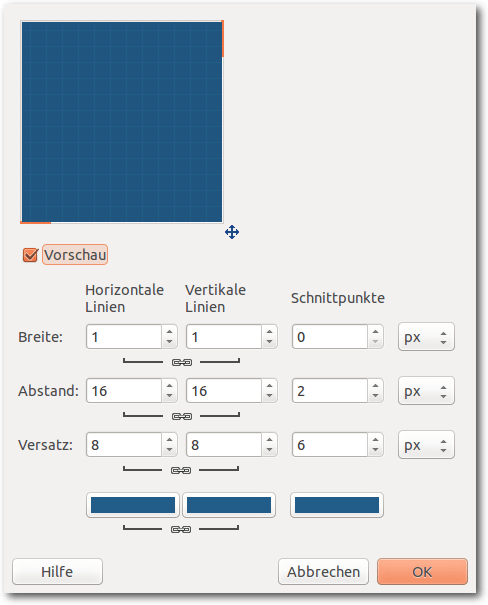

Tipp 48: Helligkeit und Kontrast anpassen

Im „Farben“-Menü findet sich als „Helligkeit/Kontrast …“ ein besonders

einfaches Werkzeug, mit dem sich diese beiden Parameter in Bildern verändern

lassen. Die gesamte Anwendung beschränkt sich auf das Einstellen zweier

Schieberegler im sich öffnenden Dialog. Das Bildfenster zeigt dabei eine

Vorschau.

Helligkeit und Kontrast anpassen.

Dieses Werkzeug arbeitet ziemlich grob, sodass erfahrene Anwender es

meistens meiden. Aber zwei Punkte sind bei diesem Werkzeug interessant:

- Unter „Einstellungen:“ findet sich eine Liste mit Daten, an denen das

Werkzeug zuletzt verwendet wurde. Man kann in dieser Liste einen Eintrag

auswählen und erhält dann die damit vorgenommenen Einstellungen. Sind diese

für weitere Bilder interessant, so ermöglicht der kleine „+“-Button, den

Einstellungen einen Namen zu geben, unter dem GIMP die Einstellungen dann

dauerhaft speichert.

- Sollte man mit diesem Werkzeug keine ausreichenden Effekte erzielen

können, so bietet der große Button „Diese Einstellungen als Werte

bearbeiten“ eine Möglichkeit, das nächst-feinere Werte-Werkzeug (siehe

unten) aufzurufen, ohne dass man die bereits vorgenommenen Änderungen

rückgängig machen muss.

Hinweis: Die erste oder beide Eigenschaften finden sich auch bei einigen der

anderen Werkzeuge im „Farben“-Menü, so beispielsweise bei den Werten, dem

Kurvenwerkzeug, den Schwellwerten usw.

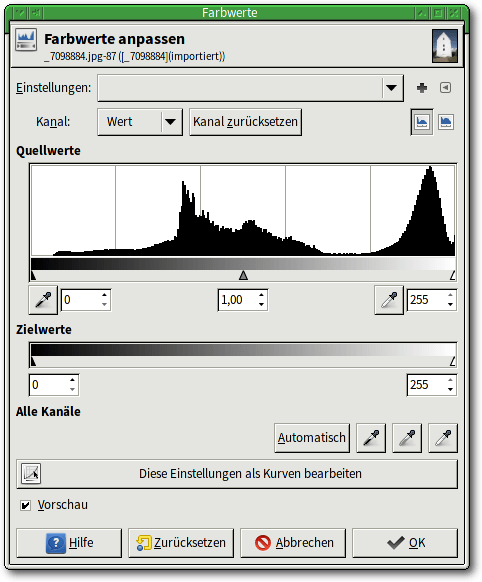

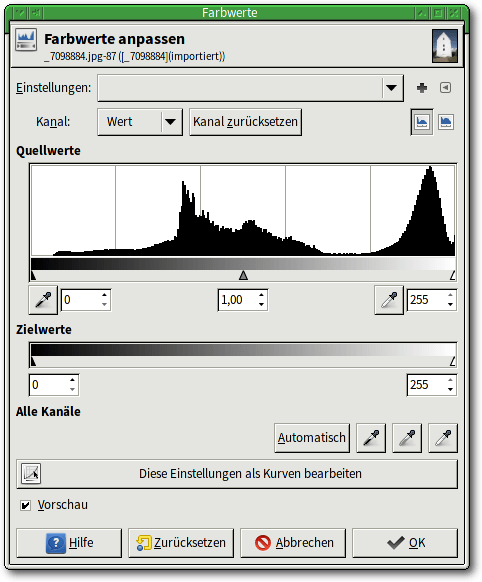

Tipp 49: Werte verändern

Mit GIMPs Werte-Werkzeug unter „Farben -> Werte …“ lassen sich die

Helligkeiten in einem Bild auf intuitive Weise schnell – und effektiv –

anpassen. Das Werkzeug besteht aus mehreren Teilen, die eng verzahnt

zusammenwirken.

Das Werte-Werkzeug verfügt über drei Regler zum Einstellen der Helligkeitsverteilung: dem Schwarzpunkt (links), dem Gamma-Wert und dem Weißpunkt (rechts).

Am oberen Rand befindet sich, wie bei vielen der Werkzeuge aus dem

„Farben“-Menü, die Möglichkeit, vorgenommene Einstellungen zu speichern.

Darunter („Kanal“) gibt es eine ebenfalls typische Möglichkeit, einen oder

alle Farbkanäle einzeln zu bearbeiten.

Die beiden Buttons am rechten Rand steuern, welche Form des Histogramms GIMP

für die darunter folgenden Fenster verwendet. Voreingestellt ist meistens

die lineare Form (links). Als Alternative bietet GIMP Ihnen ein

logarithmisches Histogramm an.

Die Arbeit mit dem Werte-Werkzeug ist recht einfach: Zunächst verschiebt man

den linken Regler (das kleine schwarze Dreieck unter dem Histogramm) so weit

nach rechts, bis der Bereich erreicht ist, wo das Histogramm die ersten

Helligkeiten (Häufigkeiten größer als Null, die Linie also sichtbar wird)

aufweist.

Diese Aktion bewirkt, dass GIMP alle Helligkeiten unterhalb des

eingestellten Wertes als ganz Schwarz (Helligkeit Null) abbildet und

entsprechend die Helligkeiten aller anderen Werte um diesen Betrag

reduziert. Diese Aktion wird auch als „Verschieben des Schwarzpunktes“ bezeichnet.

Im nächsten Schritt wiederholt man das Entsprechende mit dem Regler für die

großen Helligkeiten am rechten Rand. Man stellt ihn so ein, dass die

hellsten Bereiche in reinem Weiß (Helligkeit maximal) erscheinen. Dies wird

als „Verschieben des Weißpunktes“ bezeichnet.

Danach hat man die Möglichkeit, die „Stimmung“ des Bildes mit dem mittleren

(Gamma-)Regler zu verändern. Dies „verschiebt das Gamma“.

Man sollte die Vorschau im Bildfenster nutzen und zunächst nur kleine Anpassungen vornehmen.

Hinweis: Ob man die besseren Ergebnisse erzielt, wenn man zunächst (oder

ausschließlich) den Werte-Kanal bearbeitet oder die einzelnen Farbkanäle

separat, hängt von mehreren Faktoren (im Wesentlichen vom aktuellen Bild,

aber auch von der eigenen Erfahrung) ab.

Das Werte-Werkzeug bietet aber noch einiges mehr: Unterhalb des

„Quellwerte“-Histogramms finden Sie zwei Pipetten. Klickt man zunächst auf

dieses Symbol, wandelt GIMP den Mauszeiger entsprechend um. In diesem Modus

kann man spezielle Farben – oder wie hier Helligkeiten – aus dem Bildfenster

in das Werkzeug übernehmen. Mit der linken Pipette legt man den

Schwarzpunkt, mit der rechten den Weißpunkt fest.

Das kann GIMP auch automatisch erledigen. Dazu genügt ein Mausklick auf den

Button „Automatisch“. Alternativ stehen einem hier auch drei Pipetten zur

Verfügung, um die automatisch ermittelten Werte noch anzupassen. Dazu klickt

man mit der entsprechenden Pipette für den Schwarzpunkt, das Gamma oder den

Weißpunkt dort in das Bild, wo man die Helligkeit übernehmen will. Man kann

dies auch mehrfach machen, wenn es erforderlich ist.

Als letztes sollte man den Button „Diese Einstellungen als Kurven bearbeiten“

kennen. Er aktiviert das Kurvenwerkzeug (siehe unten), mit dem

sich die feinsten Helligkeitsanpassungen vornehmen lassen.

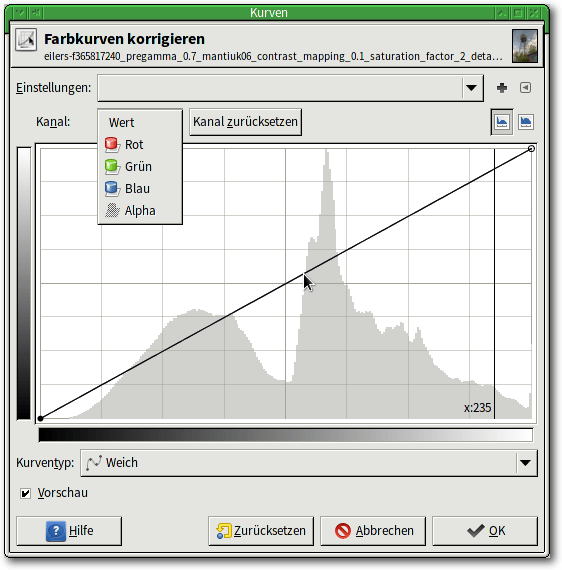

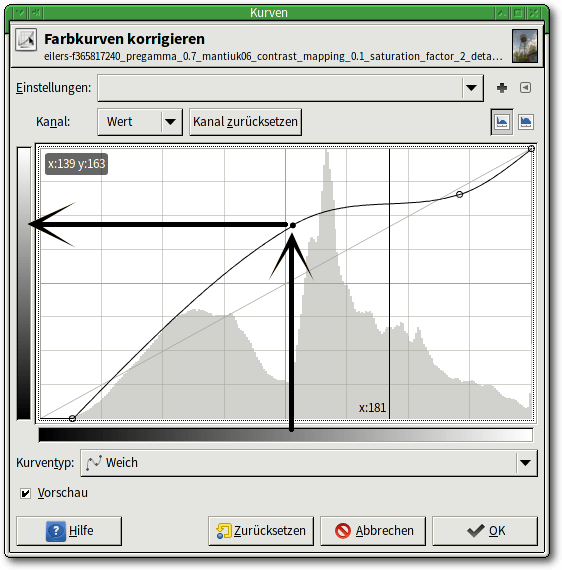

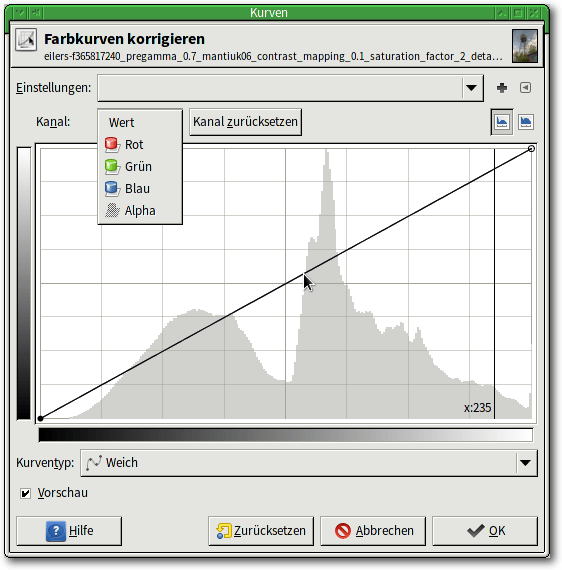

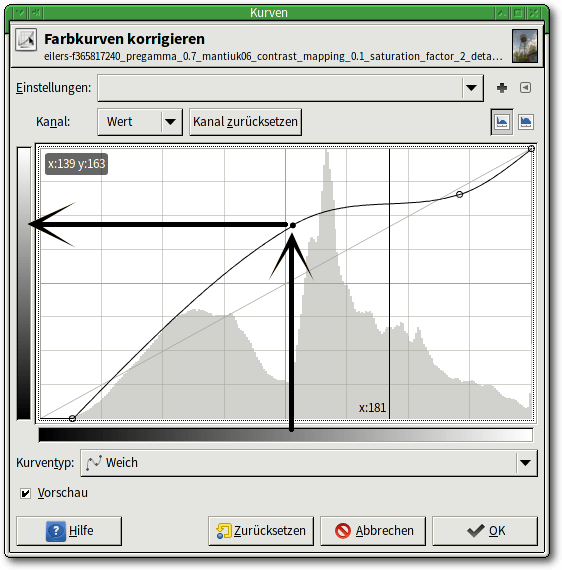

Tipp 50: Das Kurvenwerkzeug einsetzen

GIMPs Kurvenwerkzeug (auch „Gradationskurven“ genannt) unter

„Farben -> Kurven“ dient zur besonders feinen Anpassung von Helligkeiten.

Dazu erlaubt es, die Farbkanäle einzeln oder die Helligkeit insgesamt durch

beliebige Abbildungskurven zu manipulieren. Es erweitert die Funktion des

Werte-Werkzeugs um eine wesentliche Möglichkeit, sodass erfahrene Anwender

normalerweise mit dem hier beschriebenen Werkzeug arbeiten.

Das Kurvenwerkzeug erlaubt, die Helligkeiten in einzelnen Kanälen oder insgesamt zu manipulieren.

Wie beim Werte-Werkzeug zeigt der Dialog im oberen Teil – unter dem

Dateinamen des aktuellen Bildes – die Möglichkeit, Einstellungen zu speichern.

Es folgt unter „Kanal:“ die Auswahl des zu bearbeitenden Kanals. „Wert“

steht dabei für die Kombination aus Rot, Grün und Blau.

Das darunter erscheinende Fenster stellt ein Histogramm dar, dessen Form –

linear oder logarithmisch – die beiden rechts darüber angeordneten Button

umschalten.

Zwei Farbbalken am linken und unteren Rand sowie die schwarze Linie auf dem

Histogramm steuern, wie die Farben bzw. Helligkeiten umgesetzt werden. Horizontal sind die Eingangswerte,

vertikal die daraus resultierenden

Ausgabewerte dargestellt.

Der Verlauf der Linie steuert, wie die Umsetzung im Detail erfolgt: Von

einem Eingangswert geht man gerade nach oben, bis man die Linie erreicht und

dann direkt nach links. Dort findet man den resultierenden Ausgabewert.

Solange die Linie eine gerade Diagonale ist, ändern sich die Werte

nicht, wohl aber, sobald die Kurve verformt wird.

Wie das Kurvenwerkzeug wirkt, erklärt dieses Bild. Der hier gezeigte Kurvenverlauf wird in den meisten Fällen übertrieben sein.

Die Anwendung des Kurvenwerkzeugs erfolgt analog zum Werte-Werkzeug:

Zunächst sollte man den Schwarzpunkt festlegen. Dazu verschiebt man den

linken Bezugspunkt des Kurvenwerkzeugs so weit nach rechts, bis sich das

Histogramm von der X-Achse erhebt. Analog kann man den Weißpunkt

verschieben, was allerdings nicht immer sinnvoll oder erforderlich ist.

Das Gamma gibt es in der klassischen Form, wie im Werte-Werkzeug nicht mehr.

Dafür kann man die Linie aber beliebig verformen. Ein Mausklick auf die

Linie erzeugt einen neuen Stützpunkt. Überflüssige Stützpunkte verschiebt

man einfach an linken oder rechten den Rand, um sie zu löschen.

Normalerweise erzeugen leicht gekrümmte, liegende „S-Kurven“ kontrastreiche

und gut ausgeleuchtete Bilder. Natürlich hängt das Ergebnis ganz wesentlich

vom Ausgangsbild ab.

Um die Helligkeiten eines ganz bestimmen Bereichs im Bild – beispielsweise

in den Schatten im Vordergrund – anzupassen, geht man wie folgt vor: Man

klickt nach dem Öffnen der Kurven mit der Maus auf die entsprechende Stelle

im Bild. In dem Moment erzeugt GIMP eine vertikale Linie im Kurvenwerkzeug,

die genau die dort im Bildfenster vorhandene Helligkeit anzeigt. Die Kurve

kann nun den Wünschen entsprechend angepasst werden.

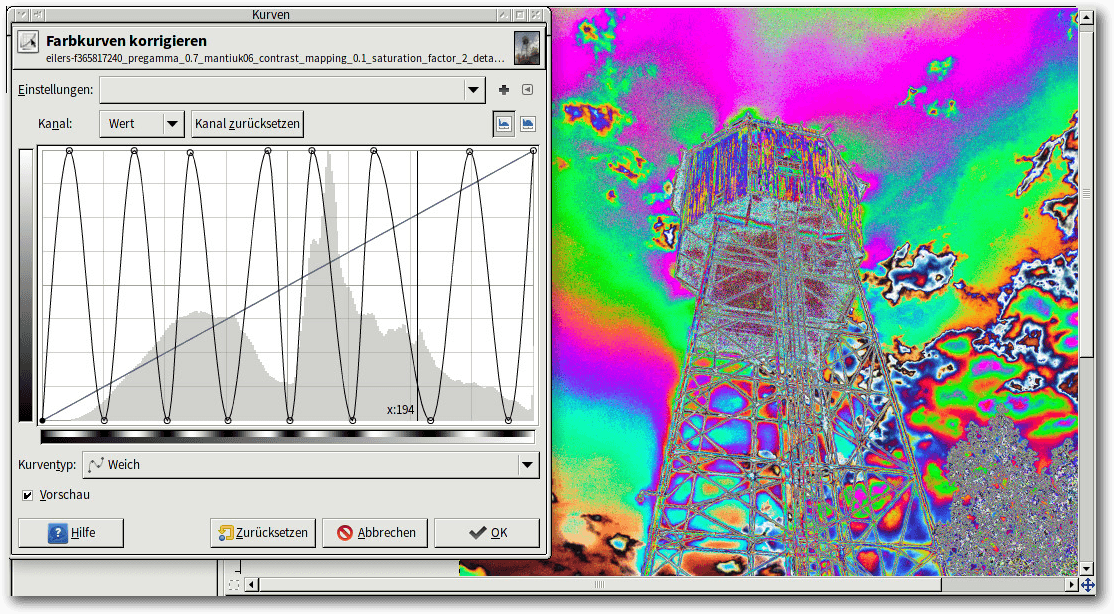

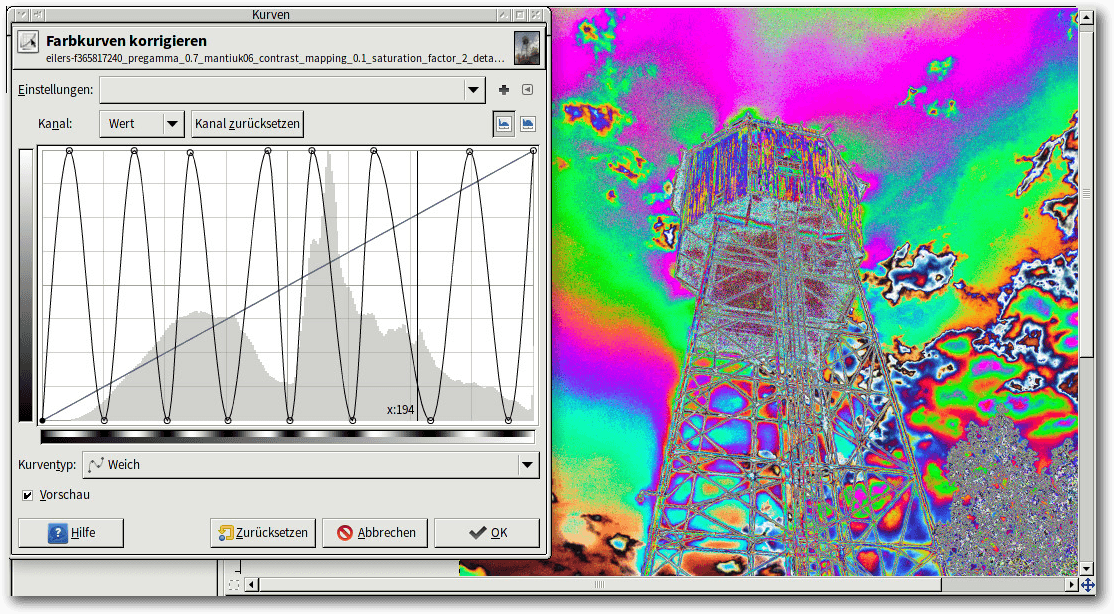

Hinweis: Man kann auch mit ganz „unlogischen“ Kurven arbeiten und erhält dann surreale Ergebnisse, beispielsweise eine „Solarisation“.

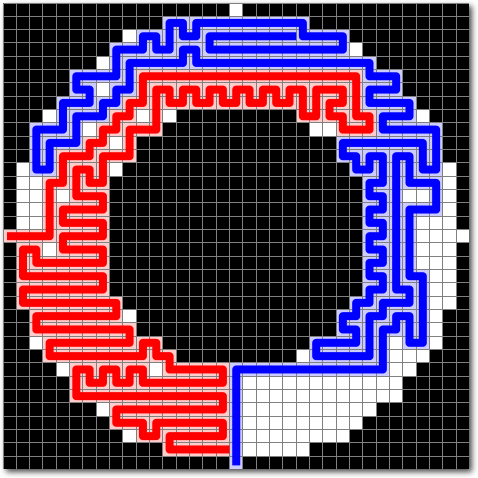

Durch die links gezeigte Kurve erzeugt man den Solarisations-Effekt.

Hinweis: Die hellsten bzw. dunkelsten Bereiche in einem Bild findet man mit dem Schwellwerte-Werkzeug.

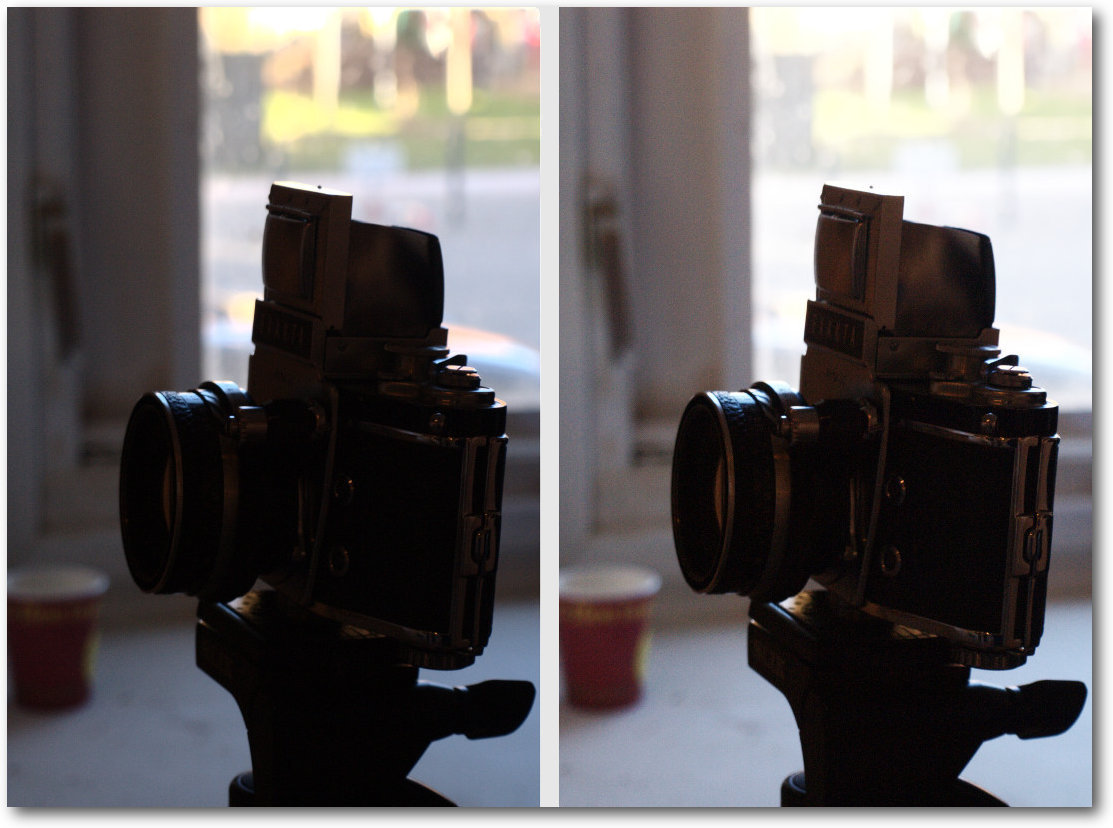

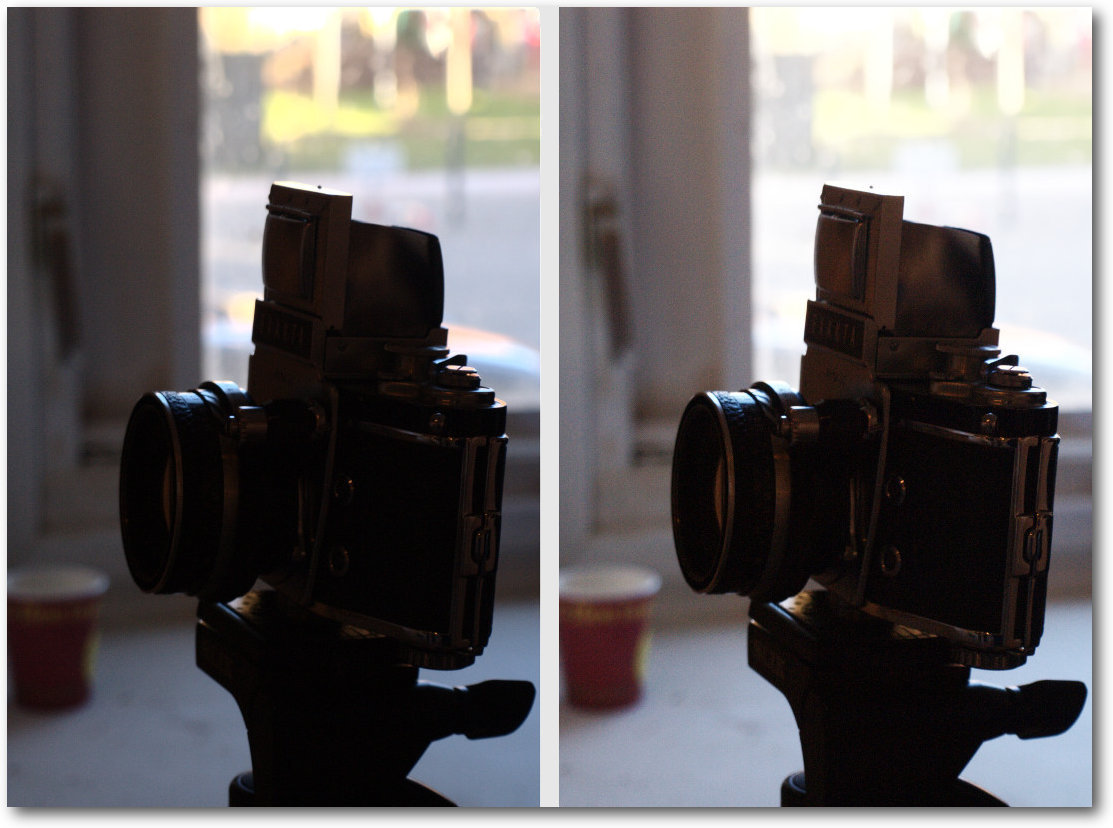

Tipp 51: Die Ebenenmodimethode anwenden

Besonders bei sehr dunklen Bildern lassen sich oft gute Ergebnisse auf eine ganz einfache Weise erzielen. Hierfür benötigt man zwei identische Ebenen, die mittels eines speziellen „Ebenenmodus“ so miteinander verrechnet werden, dass die dunklen Bereiche stärker aufgehellt werden als hellere.

Hierzu geht man wie folgt vor:

- Zunächst lädt man das gewünschte Bild.

- Dann dupliziert man die Ebene. Das geschieht am schnellsten im Ebenendock

mit einem Klick auf den mittleren Button oder über das Menü „Ebene -> Ebene duplizieren“.

- Danach ändert man den Ebenenmodus der oberen Ebene auf „Bildschirm“.

Sofern beide Ebenen sichtbar sind, erhält man als Ergebnis ein Bild, bei dem die dunklen Bereiche („Schatten“) deutlich stärker aufgehellt wurden als die hellen.

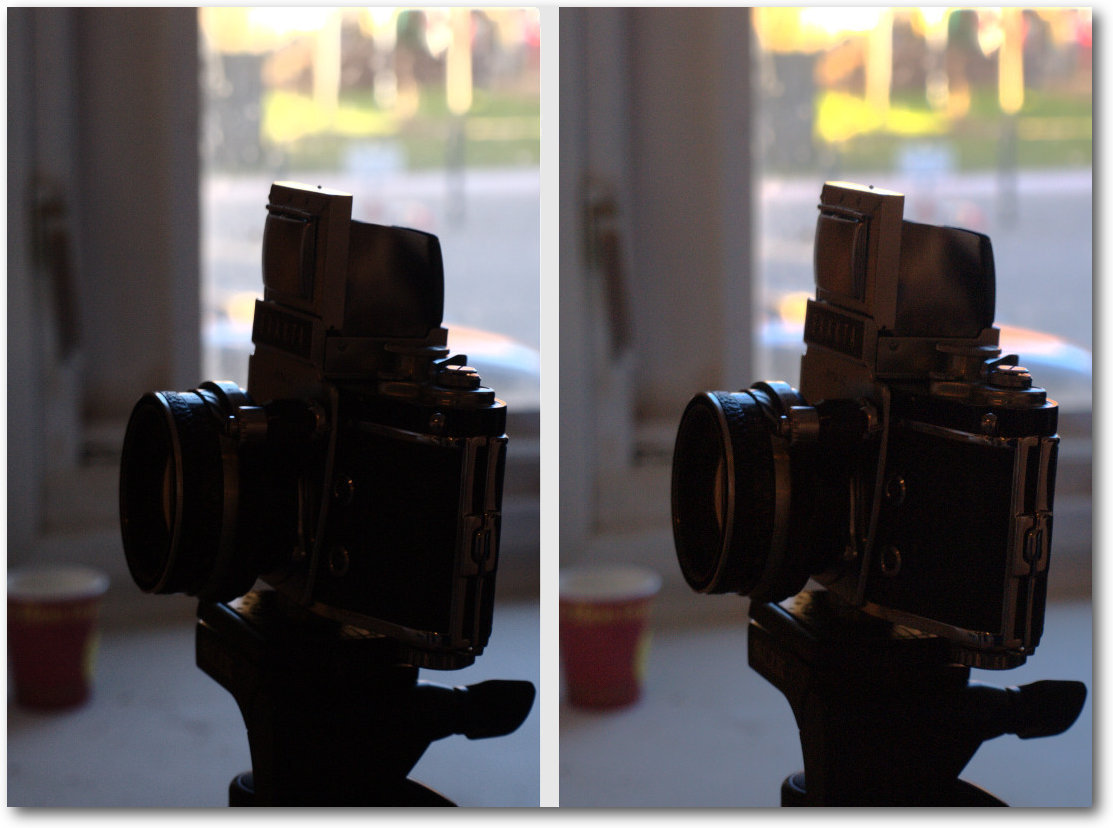

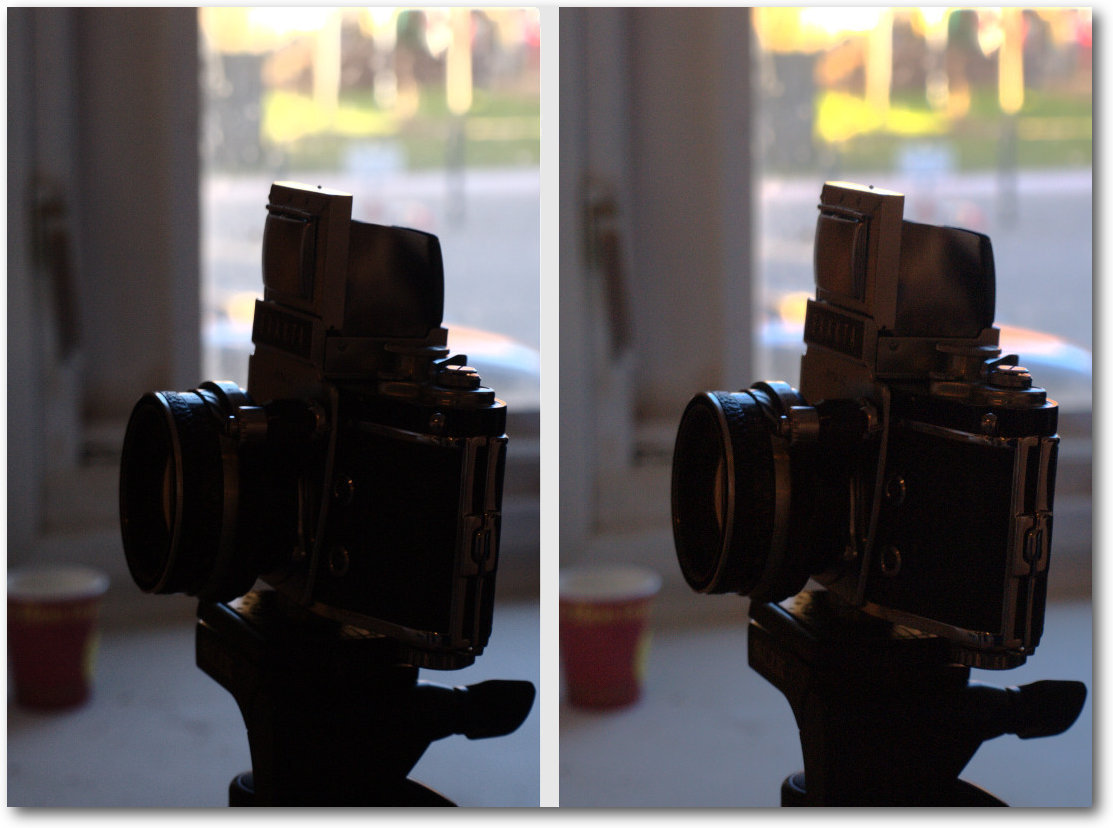

Originalbild (links) und verbesserte Version, in der sich zusätzliche Details in den dunklen Bereichen zeigen.

Hinweis: Bemerkenswert ist bei dieser Methode der geringe Arbeitsaufwand und

das interessante Ergebnis. Während eine Anpassung der Kurven auch die

helleren Bereiche im Hintergrund weiter aufgehellt hätte, geschieht das mit

dieser Methode kaum.

Dieser Effekt kann noch verstärkt werden, indem man die obere Ebene nochmals

dupliziert.

Falls das Duplizieren einen zu starken Effekt hat, setzt man einfach die

Deckkraft der oberen Ebene herunter.

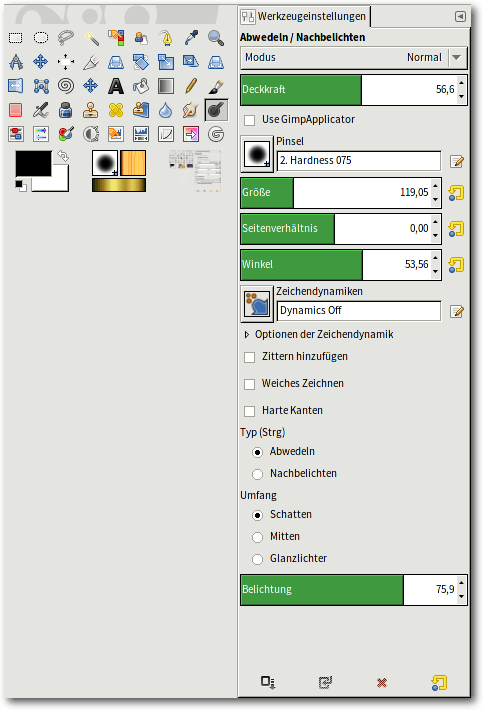

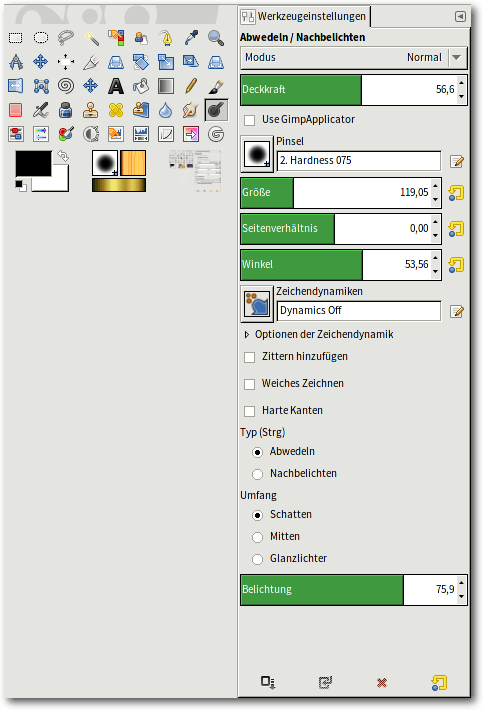

Tipp 52: Feine Retuschen mit Malwerkzeugen durchführen

Immer wenn es darum geht, einzelne Teile von Bildern sehr gezielt zu

verändern, sollte man überlegen, ob dafür nicht Malwerkzeuge in Frage

kommen. Bei Retuschen dieser Art kann man die unterschiedlichsten

Veränderungen vornehmen. Im Folgenden beschränkt sich die Betrachtung

jedoch zunächst nur auf gezielte Anpassungen der Helligkeiten.

GIMP verfügt über ein spezielles Werkzeug für diese Aufgaben, welches

„Abwedeln/Nachbelichten“-Werkzeug genannt wird. Der Name des Werkzeugs leitet sich dabei von

der Fotochemie ab. In einem Fotolabor wurden zwei Techniken verwendet, um

die Helligkeiten beim Erstellen der Abzüge kontrolliert anzupassen:

- Beim „Abwedeln“ bewegte der Laborant während der Belichtung schnell einen

Papierstreifen über das zu belichtende Positiv. Dadurch fiel auf diese

Flächen weniger Licht, das Bild wurde dort heller (es ist ein

„Umkehrprozess“!).

- Für das „Nachbelichten“ wurde eine Schablone mit weichem Rand erstellt,

die auf das Bild gelegt wurde. Anschließend wurde das Bild ein zweites Mal

belichtet. Die nicht abgedeckten Teile wurden dadurch dunkler.

Das Werkzeug „Abwedeln/Nachbelichten“ simuliert diese Techniken. In dem

Modus („Typ“) „Nachbelichten“ macht man Bereiche dunkler, auf denen man

malt, mit „Abwedeln“ hellt man sie auf. Die „Strg“-Taste schaltet beide

Modi um.

Wichtig: Damit die vorgenommenen Korrekturen mit diesem Werkzeug nicht

auffallen, sollte man

unbedingt mit einer weichen Pinselspitze arbeiten.

Eventuell ist auch der Einsatz der Option „Zittern hinzufügen“ sinnvoll,

die allzu gerade – unnatürlich wirkende – Linien verhindert.

Mit dem Malwerkzeug Abwedeln/Nachbelichten“ lassen sich mit einem (weichen) Pinsel genaue Retuschen der Helligkeiten vornehmen.

Wichtig ist noch die Einstellung unter „Umfang“: Dort legt man fest, auf

welche Helligkeiten das Werkzeug wirken soll. Mit „Schatten“ wirkt es

besonders stark auf dunkle Bildteile, mit „Glanzlichter“ auf die sehr hellen.

Die Optionen dieses Werkzeugs sind so umfangreich, dass sie sich auf

kleinen Monitoren nur partiell oder an anderer Position anzeigen lassen.

Hinweis: Dieses Werkzeug wird zusammen mit dem Verschmieren-Werkzeug

besonders gern zur Bearbeitung von Portraits eingesetzt. Dort erlaubt es durch das

Aufhellen von Falten, unauffällig kleinere Schönheitskorrekturen vorzunehmen.

Hinweis: Oft ist es bei der Verwendung von Malwerkzeugen eine gute Idee,

nicht das Bild selbst, sondern eine (Ebenen-) Kopie zu bearbeiten,

um später gegebenenfalls noch Teile aus dem Originalbild übernehmen zu können.

Mit einem Malwerkzeug lassen sich die noch im Bild vorhandenen feinen Details – in den dunklen Bereichen – ganz gezielt herausarbeiten.

Tipp 53: Eine Kontrastmaske nutzen

Eine „Kontrastmaske“ hilft, starke Helligkeitsunterschiede in Bildern so

aufzubereiten, dass das

Ergebnis deutlich ausgewogener erscheint. Meistens

wird diese Methode bei Bildern mit deutlich zu dunklen Bereichen eingesetzt.

Es gibt viele Möglichkeiten, eine Kontrastmaske zu erzeugen. Neben G'MIC,

das einen speziellen Filter dafür mitbringt („Contrast Swiss Mask“ genannt),

lässt sich dieser Effekt auch schnell und einfach selbst erstellen. In diesem Fall

hat man die Möglichkeit, auf alle Parameter Einfluss zu nehmen und

alles im Detail steuern zu können.

Es sind nur sehr wenige Schritte zum Erstellen einer Kontrastmaske erforderlich:

- Zuerst lädt man das gewünschte Bild.

- Dann dupliziert man die Ebene. Das geschieht z. B. im Ebenendock

mit dem mittleren Button oder über „Ebene -> Ebene duplizieren“.

- Über „Farben -> Entsättigen“ entsättigt man

diese Ebene, die dann schwarz-weiß ist.

- Diese schwarz-weiße Ebene invertiert man über „Farben -> Invertieren“.

- Nun zeichnet man das Ergebnis etwas weicher. Das geschieht normalerweise

mit dem Filter „Gaußscher Weichzeichner“ aus dem Menü

„Filter -> Weichzeichnen“.

- Zuletzt ändert man den Ebenenmodus auf „Bildschirm“.

Die selbst erstellte Kontrastmaske hilft in diesem Beispiel die zu dunklen Bereiche aufzuhellen, ohne dass die Lichter ausbrennen.

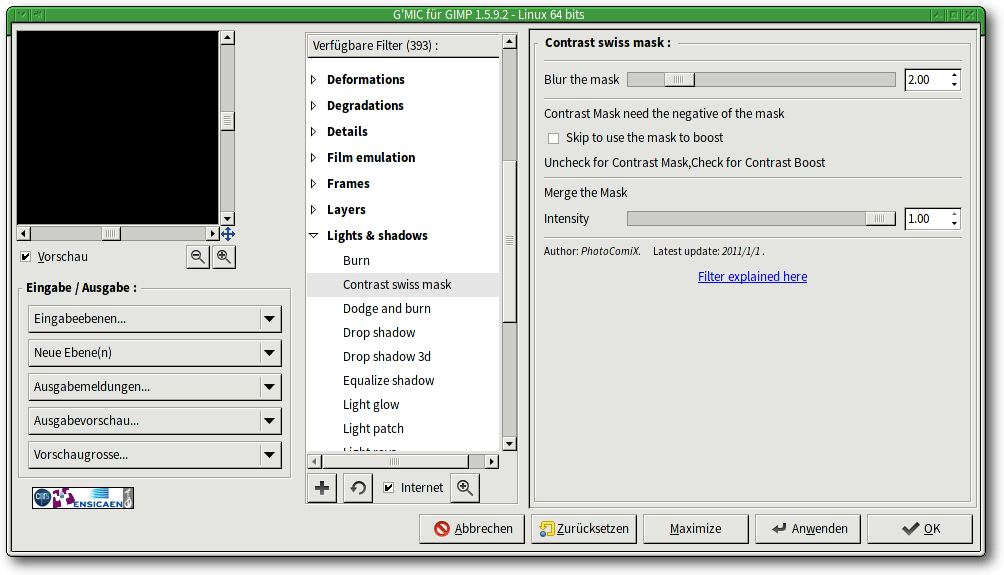

Tipp 54: G'MICs „Contrast Swiss Mask“ verwenden

Der Filter „G'MIC“ gehört mit zu den wichtigsten Erweiterungen für GIMP und

wird daher von

erfahrenen Anwendern meistens gleich mit installiert. Seine

besondere Stärke besteht in der Vielzahl zusätzlich verfügbarer Filter, die für ganz

unterschiedliche Aufgaben entwickelt wurden. Die meisten dieser Filter

bieten eine gute Vorschau und liefern mit relativ geringem Aufwand gute Resultate.

Um die „Contrast Swiss Mask“ anzuwenden, geht man wie folgt vor:

- Zuerst lädt man das gewünschte Bild.

- Danach ruft man den Filter über „Filter -> G'MIC -> Light & Shadows -> Contrast swiss mask“ auf.

- Nun wählt man noch einen geeigneten Ausgabemodus unter „Eingabe/Ausgabe -> Neue Ebene(n)“.

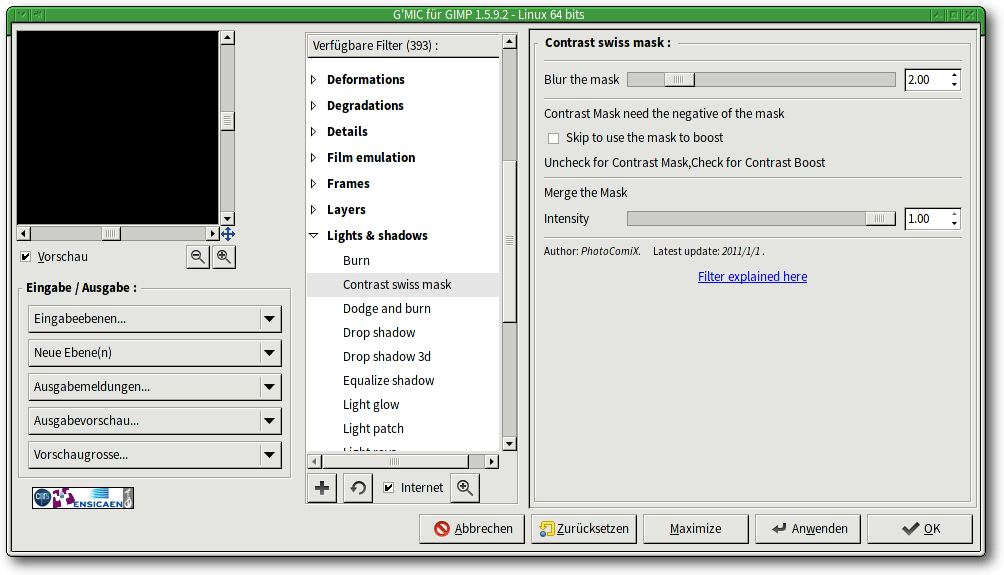

G'MICs-Filter sind in vielen Kategorien eingeordnet, „Contrast Swiss Mask“ findet man unter „Light & Shadows“.

„OK“ schließt den Dialog und berechnet das Ergebnis, „Anwenden“ hat den gleichen Effekt,

ohne den Dialog zu schließen.

Hinweis: Dieser Filter wirkt auf die angegebene Weise nur solange die Option

„Skip to use the mask to boost“ nicht aktiviert ist. Mit dieser Option

erhält man den gegenteiligen Effekt. Die dann erzeugten Ebenen weisen sehr harte Kontraste auf.

Unter „Merge the Mask“ stellt man ein, wie stark GIMP die Maske mit dem

Originalbild verrechnen soll.

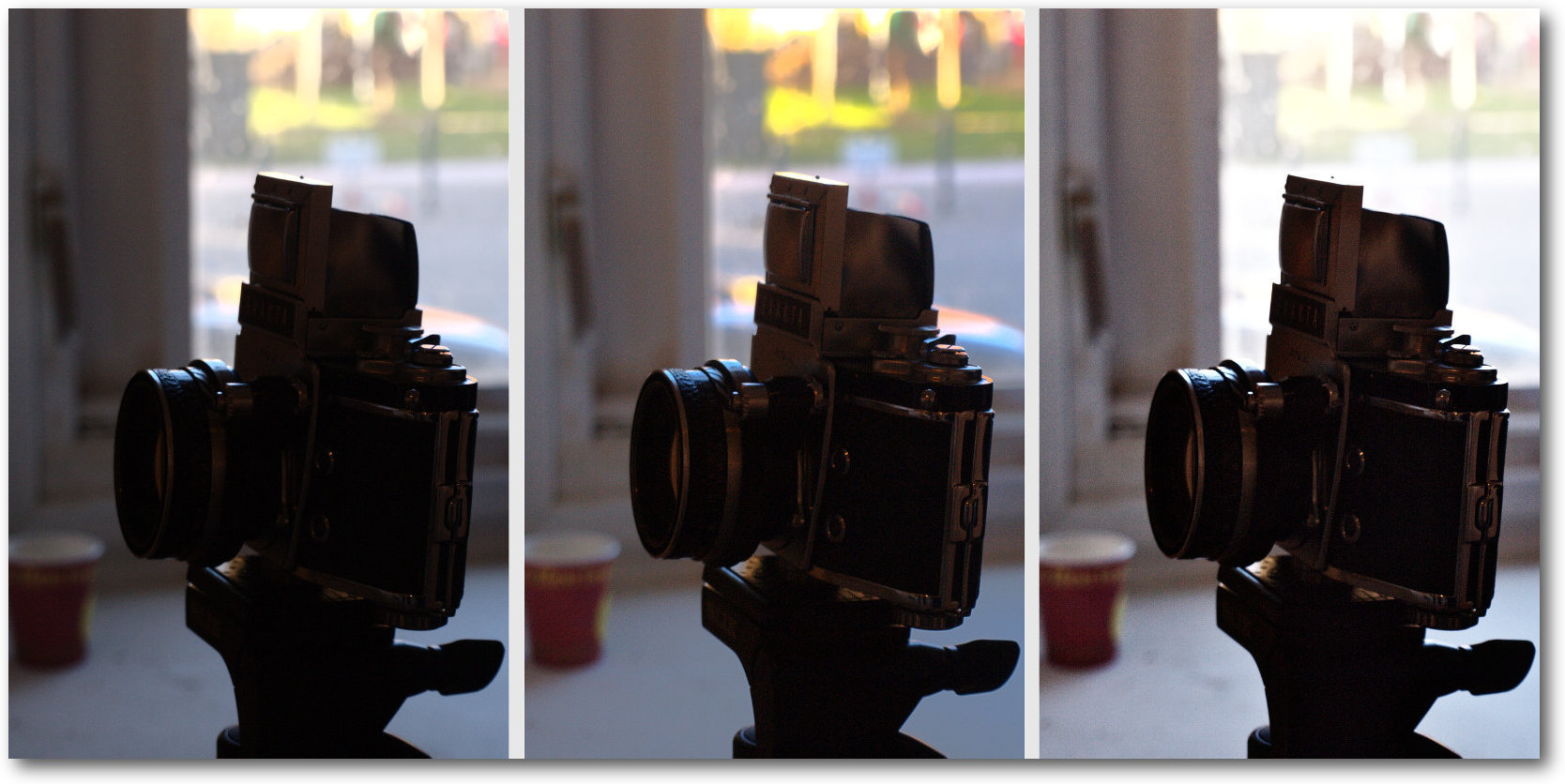

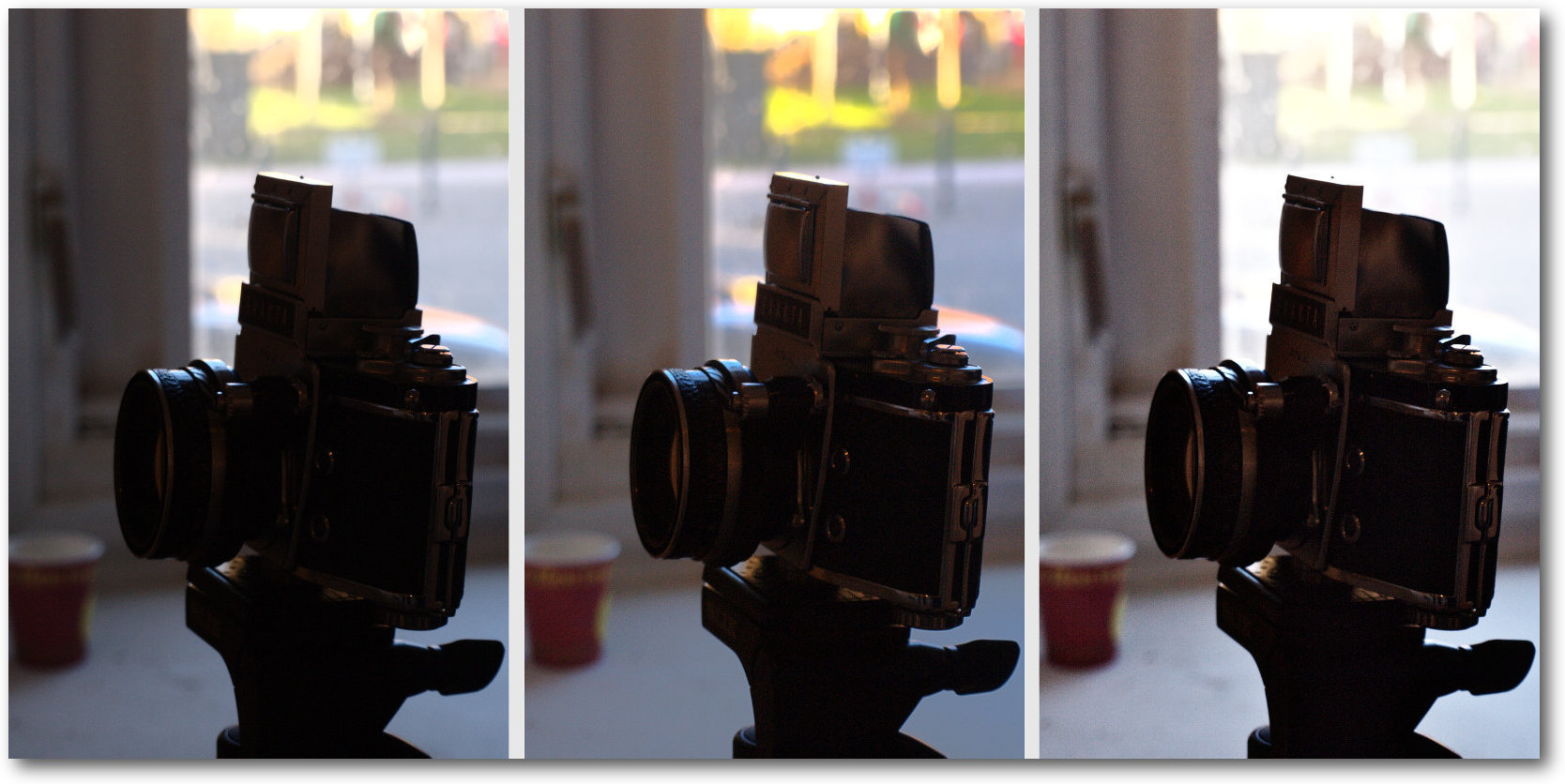

G'MIC verfügt gleich über mehrere Filter, die unterschiedliche Kontrastmasken erzeugen können: Originalbild (links), „Contrast Swiss Mask“ (Mitte), „Local Contrast Enhancement“ (rechts).

Links

[1] http://www.bookrix.de/_ebook-wilber-gimper-bildbearbeitung-mit-gimp-die-101-wichtigsten-tipps/

| Autoreninformation |

| Die GIMPer

sind eine wechselnde Gruppe von GIMP-Freunden und -Nutzern, die das

Programm für ihre Kunstprojekte, Arbeit oder Hobby einsetzen und

versuchen, alle wesentlichen Aspekte zu beleuchten.

|

Beitrag teilen Beitrag kommentieren

Zum Inhaltsverzeichnis

von Sujeevan Vijayakumaran

Im zweiten Teil des Git-Tutoriums (siehe freiesMagazin

01/2015 [1]) wurde ein Überblick

über das Branching-Modell gegeben. Dieser dritte Teil rundet den Einstieg in

Git ab, womit man für die gängigsten Aufgaben gewappnet sein sollte. Dies

umfasst zum einen das Rebasing und zum anderen das Arbeiten mit

Remote-Repositorys.

Rebasing

Das Rebasing gehört ebenfalls zum Branching-Modell von Git. Im vorherigen Teil

des Tutoriums wurde Branches mit dem git merge Befehl zusammengeführt. Eine

andere Art der Zusammenführung von Branches ist das Rebasing.

Beim normalen Mergen werden beide Branches zusammengeführt und gegebenenfalls

ein Merge-Commit erzeugt. Anders sieht es beim Rebasing aus: In diesem Fall

werden die Commits aus einem Branch einzeln auf den Haupt-Branch angewendet.

Ein Unterschied zum normalen Merge ist, dass in der Historie des Repositorys

beziehungsweise des Branches keine der vorherigen angelegten Branches mehr

sichtbar sind.

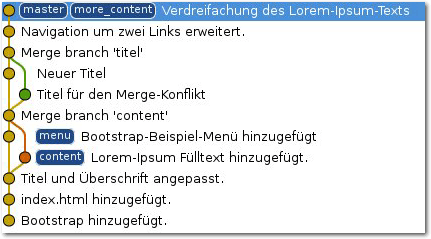

Um die Funktionsweise besser zu erläutern, folgt das erste

Beispiel, wofür wieder jeweils ein Commit auf zwei Branches gebraucht wird.

Zunächst muss man sicherstellen, dass man sich auf dem Branch master befindet,

von dem man dann den zweiten Branch namens more_content anlegt.

$ git checkout master

$ git checkout -b more_content

Auf diesem Branch muss man nun in der Datei index.html ein wenig mehr Inhalt

hinzufügen. Dazu reicht es, etwa den Lorem-Ipsum Text in dem <p>-Tag zu

verdreifachen. Die Änderung kann dann wieder wie gewohnt durch einen Commit übernommen werden.

$ git add index.html

$ git commit -m "Verdreifachung des Lorem-Ipsum-Texts"

[more_content 609f8a4] Verdreifachung des Lorem-Ipsum-Texts

1 file changed, 6 insertions(+)

Einen Commit auf dem Branch more_content gibt es an dieser Stelle somit auch

schon. Jetzt muss man zunächst mit dem Befehl git checkout master wieder

zurück auf den Branch master wechseln und dort einen Commit erzeugen.

In der Datei index.html kann man nun für den ersten Commit in der Navigation

folgende Zeile verdreifachen:

<li><a href="#">Link</a></li>

Anschließend kann man den ersten Commit tätigen:

$ git add index.html

$ git commit -m "Navigation um zwei Links erweitert."

[master 8d8d6ce] Navigation um zwei Links erweitert.

1 file changed, 2 insertions(+)

Im zweiten Teil dieser Artikel-Reihe hätte man an dieser Stelle einen Merge

gemacht. Konkret würde bei einem git merge more_content der eine Commit aus

dem Branch more_content in den Branch master gemergt und es würde

zusätzlich ein weiterer Merge-Commit entstehen.

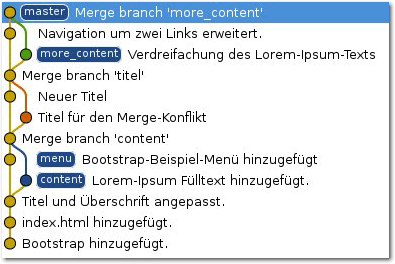

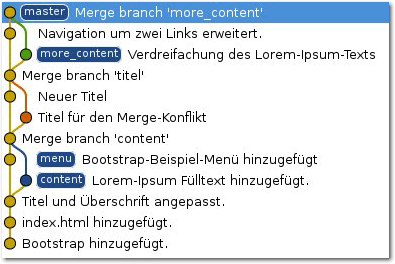

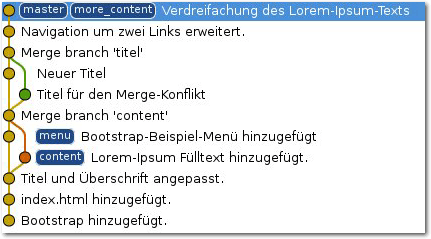

So sähe die Zusammenführung der Branches bei einem normalen Merge aus.

Den Merge-Commit möchte man beim Rebasen allerdings vermeiden. Ziel des

Rebasing ist es, dass man den ursprünglichen Entwicklungsbranch nicht mehr sieht

und er dann aussieht wie ein gerader Entwicklungs-Strang. Hier stellt sich

natürlich die Frage, was jetzt die genauen Vorteile und auch Nachteile vom

Rebasen gegenüber dem Mergen ist. Wie bereits oben im Text erwähnt, werden die

Commits einzeln auf dem Branch neu angewendet. Die genaue Funktion wird klarer,

wenn man es einmal durchgeführt hat. Hierfür wechselt man zunächst zurück auf

den Branch more_content und macht dort den Rebase.

$ git checkout more_content

$ git rebase master

Zunächst wird der Branch zurückgespult, um Ihre Änderungen

darauf neu anzuwenden...

Wende an: Verdreifachung des Lorem-Ipsum-Texts

Wenn man also auf dem Branch more_content ist und die Änderungen aus dem

Branch master übernehmen möchte ohne einen Merge-Commit zu haben, dann muss

man git rebase master ausführen. Wie man aus der Terminal-Ausgabe ablesen

kann, wird der Branch zunächst „zurückgespult“, das heißt, dass in diesem

Schritt die gemachten Änderungen vorübergehend zurückgenommen

werden. Anschließend übernimmt Git die Commits aus dem anderen Branch, in

diesem Fall aus dem Branch master. Zum Schluss werden die Commits vom Branch

einzeln wieder angewandt. Da es sich in diesem Beispiel um lediglich einen

Commit handelt, wird auch nur dieser angewandt.

Klarer wird es, wenn man sich die Commits auf einem Branch als einen Stapel

vorstellt. Beim Rebase wird auf more_content sozusagen jeder Commit vom

Stapel genommen, bis man einen gemeinsamen Commit vom Branch master gefunden

hat. An diesem Punkt werden dann die neuen Commits von master wieder auf

more_content gestapelt. Anschließend werden die vorläufig entfernten Commits

auf more_content wieder einzeln auf den Commit-Stapel gelegt.

Jetzt lohnt sich ein Blick in das Log. Relevant sind lediglich die letzten drei

Commits, welche man sich mit dem Parameter -n 3 für den aktuellen Branch

anzeigen lassen kann.

$ git log -n 3

commit 27bf2ae348279599cfa67fd0631e7f3e5c90840d

Author: Sujeevan Vijayakumaran <mail@svij.org>

Date: Sun Jan 4 19:03:23 2015 +0100

Verdreifachung des Lorem-Ipsum-Texts

commit 8d8d6ce271ddf776def806bbe65c1439c84f8c67

Author: Sujeevan Vijayakumaran <mail@svij.org>

Date: Sun Jan 4 19:12:42 2015 +0100

Navigation um zwei Links erweitert.

commit aa2fbe6716f743d434a0f7bec9b97548304338c8

Merge: b967fa1 b6781c8

Author: Sujeevan Vijayakumaran <mail@svij.org>

Date: Sun Jan 4 15:54:15 2015 +0100

Merge branch 'titel'

Conflicts:

index.html

Im Git-Log steht oben immer der neueste Commit auf dem Branch. Wer jetzt

allerdings genau hinsieht, merkt, dass der oberste Commit um 19:03 Uhr

getätigt wurde und der Commit darunter um 19:12 Uhr. Zeitlich betrachtet ist

also der vorletzte Commit der neueste Commit, während der echte neueste Commit

zeitlich vorher erzeugt wurde. Dies ist eine Eigenschaft, die genau dann beim

Rebasen zustande kommt. In der Historie eines Git-Repositorys sind die Commits

nämlich immer in logische Reihenfolge und diese ist nicht zwangsläufig auch die

zeitlich richtige Reihenfolge. Es stellt sich für viele vermutlich an dieser

Stelle die Frage: Warum brauche ich das?

Beim Entwickeln von Software werden häufig einzelne Features gleichzeitig

entwickelt. Wenn etwa der Branch master nur vollständige und somit fertige

Features enthält, dann werden dort immer nur die Änderungen zusammengeführt,

wenn die Branches fertig sind. Wenn man allerdings an einem größeren Feature

entwickelt, welches durchaus längere Zeit braucht, dann zweigt man

beispielsweise vom Branch master ab und entwickelt für eine Zeit dort sein

Feature. Über die Zeit hinweg läuft allerdings auch die Entwicklung auf dem

Branch master weiter, was heißt, dass diese beiden Entwicklungszweige

gegebenenfalls immer stärker divergieren. Ein Konflikt-freies Mergen beider

Branches nach längerer Entwicklungszeit ist dann gegebenenfalls nicht mehr so

einfach möglich. Wenn man nun auf dem Entwicklungsbranch ein Rebase

durchführt, dann sind da auch alle Änderungen von master enthalten. Dieses

Vorgehen ist auch dann sinnvoll, wenn der Entwickler auf dem Entwicklungsbranch die

Änderungen aus master braucht. Unschön wäre hier ein Merge, da man in der

Historie beim mehrmaligen Mergen von master diverse Merge-Commits besitzt,

die man durch das Rebasen einfach vermeiden kann.

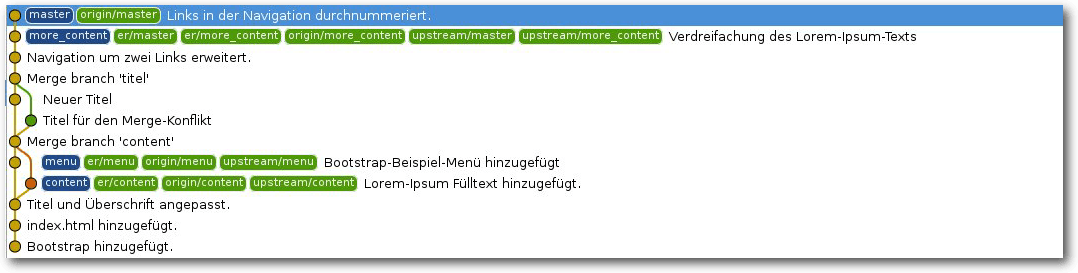

Nach dem Rebase möchte man die Änderungen vom Branch more_content

letztendlich auch in master übernehmen. Hierfür reicht dann wieder ein

normaler Merge:

$ git checkout master

$ git merge more_content

Aktualisiere 8d8d6ce..27bf2ae

Fast-forward

index.html | 6 ++++++

1 file changed, 6 insertions(+)

Der Merge ist dann ein Fast-Forward Merge. Wenn man nun erneut in das Git Log

von master schaut, dann sieht man keinerlei Informationen mehr von der

Existenz des Branches more_content. Rebasing lohnt sich also auch für

Experimentier-Branches, dessen Namen man hinterher nicht mehr in der Historie

lesen möchte.

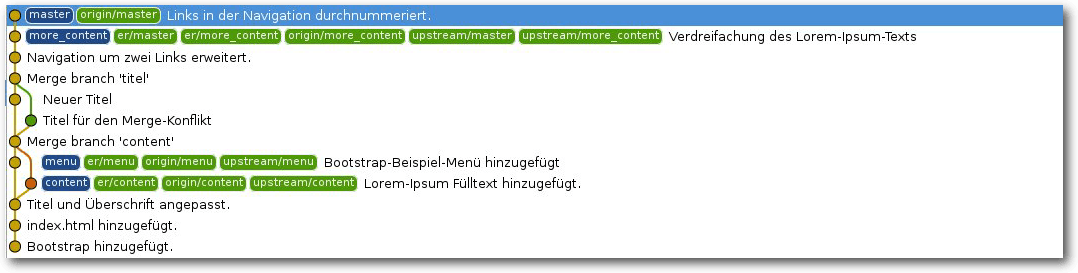

Sowohl master als auch more_content sind nach dem Rebase und Merge identisch.

Zum Schluss stellt sich noch die Frage, wann man Rebasen und wann man Mergen

sollte. Als kleine Grundregel kann man sich merken, dass man immer dann Rebasen

sollte, wenn man zeitgleich laufende Änderungen regelmäßig aus einem anderen

Branch auch in seinen eigenen Entwicklungsbranch hineinholen möchte. Ein Merge

sollte man hingegen dann machen, wenn man fertige Entwicklungsbranches in einen der

Hauptentwicklungsbranches zusammenführen möchte. Weder das eine noch das andere

lässt sich problemlos jedes Mal durchführen, sodass es häufig auch

auf die

jeweilige Situation ankommt, ob man nun rebased oder mergt.

Remote-Repositorys

Eine weitere große Stärke von Git ist, dass man ein Repository auf vielen

verschiedenen Rechnern verteilen kann. Es ist daher ein verteiltes

Versionsverwaltungsprogramm. Ein vollständiges Git-Repository kann an vielen

verschiedenen Orten liegen.

Diejenigen, welche das Git-Repository mit den zuvor angegebenen Befehlen

angelegt haben, besitzen zur Zeit nur ein lokales Repository. Wichtig für das

Verständnis ist, dass in der Theorie jedes Git-Repository mit jedem

gleichgestellt ist. In der Praxis sieht das allerdings etwas anders aus, da bei

den meisten Projekten mit einem zentralen Server gearbeitet wird.

Entfernt liegende Repositorys nennt man Remote-Repositorys. Um mit eben diesen

zu arbeiten, gibt es den Befehl git remote. Wenn keine Remote-Repositorys

hinzugefügt worden sind, wie bei diesem Beispiel-Repository, dann erfolgt keine

Ausgabe beim Ausführen des Kommandos. Es bietet sich grundsätzlich immer an,

mit Remote-Repositorys zu arbeiten. Ein Projekt, dessen Git-Repository nur auf

einem lokalen Rechner liegt, ist kaum vor Ausfällen gesichert.

Remote-Repositorys sind insbesondere deshalb nützlich, weil man damit einfach

kollaborativ arbeiten kann.

Um die Arbeitsweise mit Remote-Repositorys zu verstehen und zu erlernen, werden

zunächst einige Remote-Repositorys angelegt, die auf dem lokalen Rechner

liegen. In einem Projekt mit mehreren Personen gibt es meist ein zentrales

Repository für das gesamte Projekt sowie einzelne Repositorys für die

jeweiligen Projekt-Mitarbeiter.

Man nehme also an, dass es in diesem Beispiel-Webseiten-Projekt zwei

Mitarbeiter gibt: „Ich“ und „Er“. Dazu wechselt man erst in den Projektordner

Webseite-mit-Git, anschließend legt man die entsprechenden Repositorys an:

$ mkdir ~/Git

$ git clone --bare . ~/Git/Webseite-mit-Git.git

Klone in Bare-Repository '/home/sujee/Git/Webseite-mit-Git.git'...

Fertig.

$ git clone --bare . ~/Git/Er.git

Klone in Bare-Repository '/home/sujee/Git/Er.git'...

Fertig.

$ git clone --bare . ~/Git/Ich.git

Klone in Bare-Repository '/home/sujee/Git/Ich.git'...

Fertig.

Der Befehl git clone klont, also kopiert, das ganze Repository. Es nimmt in

diesem Fall das aktuelle Projekt und speichert es dann in unter dem lokalen

Pfad ~/Git/. Die Inhalte aller Ordner sind zu Beginn identisch und enthalten

das .git-Verzeichnis des Projekts.

Hinweis: Das oben erläuterte Anlegen von Repositorys ist keine alltägliche

Form. Es dient lediglich dazu, das Arbeiten

mit Remote-Repositorys zu erläutern, was auch geht, wenn die Repositorys lokal

auf dem Rechner liegen. In der Regel setzt man eigene Git-Server-Dienste auf

oder nutzt externe Dienste wie GitHub [2] oder

Bitbucket [3], wo man sowohl private als auch

öffentliche Repositorys anlegen kann. Auf eine genauere Anleitung wird an

dieser Stelle zunächst verzichtet, um den Rahmen des Tutoriums nicht zu

sprengen.

Jetzt ist es an der Zeit, die Remote-Repositorys mit dem Projekt zu verbinden.

Im Projekt-Ordner Webseite-mit-Git fügt man also zunächst sein privates

Repository als Remote hinzu.

$ git remote add origin ~/Git/ich.git

Dieses Kommando setzt sich aus mehreren Teilen zusammen. Der erste Parameter

remote bezieht sich auf Remote-Repository-Feature von Git. Das darauf folgende add gibt

an, dass man ein Remote-Repository hinzufügen möchte. Der Parameter add

verlangt wiederum zwei Parameter, das wäre zum einen der Name des Repositorys und zum anderen

der Pfad zum Repository. Der Pfad zum entfernten Repository kann auch über SSH,

HTTPS oder über das Git-Protokoll erfolgen. Das eigene Repository wird in der

Regel origin genannt, dort sollte man auch volle Schreibrechte besitzen.

Weiterhin bietet es sich nun an, die übrigen Remote-Repositorys hinzuzufügen,

das wären upstream und er. Das Repository upstream soll das gemeinsame

Repository beider Mitarbeiter sein, auf dem die fertige Webseite kollaborativ

erarbeitet werden soll:

$ git remote add upstream ~/Git/Webseite-mit-Git.git

$ git remote add er ~/Git/Er.git

Der Befehl git remote sollte nun drei Remotes anzeigen.

$ git remote

er

origin

upstream

Bis jetzt wurde Git nur bekanntgegeben, dass es diese Remote-Repositorys gibt.

Die Inhalte wurden noch nicht in das lokale Repository heruntergeladen. Dafür gibt

es das Git-Kommando fetch. Damit kann man die

Bestandteile eines Remote-Repositorys herunterladen.

$ git fetch upstream

Von /home/sujee/Git/Webseite-mit-Git

* [neuer Branch] content -> upstream/content

* [neuer Branch] master -> upstream/master

* [neuer Branch] menu -> upstream/menu

* [neuer Branch] more_content -> upstream/more_content

Wie man aus der Ausgabe herauslesen kann, wurden die Branches master,

content, menu und more_content vom Repository upstream

heruntergeladen. Da es sehr mühselig wäre, für jedes Remote-Repository einzeln

git fetch aufzurufen, gibt es auch eine Möglichkeit, alle

Remote-Repositorys in einem Rutsch herunterzuladen:

$ git remote update

Fordere an von upstream

Fordere an von er

Von /home/sujee/Git/Er

* [neuer Branch] content -> er/content

* [neuer Branch] master -> er/master

* [neuer Branch] menu -> er/menu

* [neuer Branch] more_content -> er/more_content

Fordere an von origin

Von /home/sujee/Git/ich

* [neuer Branch] content -> origin/content

* [neuer Branch] master -> origin/master

* [neuer Branch] menu -> origin/menu

* [neuer Branch] more_content -> origin/more_content

Alternativ kann man auch git fetch --all ausführen, welches denselben Effekt

hat.

Die Remote-Repositorys sind nun vollständig konfiguriert und liegen auch lokal

im Projekt-Ordner. Praktisch ist, dass man zwischen den einzelnen

Branches der Repositorys wechseln kann.

Mittlerweile wurden zwar einige Remote-Repositorys hinzugefügt, allerdings kann

man durchaus die vergebenen Namen nachschlagen. Es reicht, lediglich folgenden

Befehl auszuführen:

$ git remote

er

origin

upstream

Wenn man eine ausführlichere Ausgabe möchte, etwa die Adresse des

Remote-Repositorys, dann kann man dem Befehl den Parameter -v übergeben.

$ git remote -v

er /home/sujee/Git/Er.git (fetch)

er /home/sujee/Git/Er.git (push)

origin /home/sujee/Git/Ich.git (fetch)

origin /home/sujee/Git/Ich.git (push)

upstream /home/sujee/Git/Webseite-mit-Git.git (fetch)

upstream /home/sujee/Git/Webseite-mit-Git.git (push)

Aktuell sind sowohl das lokale als auch die entfernten

Repositorys auf demselben Stand.

Jetzt ist es notwendig, einen weiteren Commit zu tätigen. In diesem Beispiel

nummeriert man einfach alle Links in der Navigation aus der Datei

index.html, sodass man hinterher in der Navigation nicht mehr 4x „Link“

stehen hat, sondern „Link 1“ bis „Link 4“. Anschließend erzeugt man wieder einen

Commit mit dieser Änderung.

$ git add index.html

$ git commit -m "Links in der Navigation durchnummeriert."

[master 59b89eb] Links in der Navigation durchnummeriert.

1 file changed, 4 insertions(+), 4 deletions(-)

Damit ist zwar ein Commit angelegt worden, diesen möchte man allerdings noch in

das entfernt liegende Repository pushen. Dies ist ein gängiges Prozedere, um

die Änderungen online zu bringen, etwa um mit anderen zu kollaborieren oder um

seine Arbeiten zu sichern.

Jetzt könnte man den Push-Befehl ausführen:

$ git push

fatal: Der aktuelle Branch master hat keinen Upstream-Branch.

Um den aktuellen Branch zu versenden und den Remote-Branch

als Upstream-Branch zu setzen, benutzen Sie

git push --set-upstream origin master

Wenn man git push ohne jeglichen Parameter ausführt, dann versucht Git den

aktuellen Branch auf das Remote-Repository zu übertragen. Allerdings tut Git das

nur, wenn ein sogenannter Upstream-Branch gesetzt ist. Wie die Aussage oben

aussagt, muss man hierfür einen Upstream-Branch einrichten.

$ git push --set-upstream origin master

Zähle Objekte: 3, Fertig.

Delta compression using up to 4 threads.

Komprimiere Objekte: 100% (3/3), Fertig.

Schreibe Objekte: 100% (3/3), 408 bytes | 0 bytes/s, Fertig.

Total 3 (delta 1), reused 0 (delta 0)

To /home/sujee/Git/Ich.git

27bf2ae..59b89eb master -> master

Branch master konfiguriert zum Folgen von Remote-Branch master von origin.

Der Parameter --set-upstream lässt sich ebenfalls in einer kürzeren Variante

ausführen, dies ist dann schlicht der Parameter -u. Der Befehl führt zwei

Dinge aus: Zum einen pusht er der den Branch master zum Remote-Repository

namens origin und zum anderen verknüpft Git den lokalen Branch mit dem

Remote-Branch auf origin.

Sowohl master als auch origin/master haben einen Commit mehr als die übrigen Branches.

Wenn man nun nur noch git push ausführt, dann wird automatisch der aktuelle

lokale Branch master nach origin übertragen, sofern Änderungen vorhanden

sind.

$ git push origin master

Everything up-to-date.

Mittlerweile liegen im Repository vier Branches, wovon bereits alle Änderungen

gemergt worden sind und keine mehr gebraucht werden. Diese lassen sich ganz

einfach mit dem folgenden Befehl löschen:

$ git branch -d content

$ git branch -d menu more_content

Man kann das Löschen sowohl einzeln durchführen oder auch gesammelt innerhalb

eines Kommandos, wie es oben angegeben ist. Übrig bleibt lediglich der Branch

master. Wichtig zu wissen ist, dass hiermit ausschließlich die lokalen

Branches gelöscht worden sind. Wenn man nun auch noch auf dem Remote-Repository

die Branches löschen möchte, muss man Folgendes ausführen:

$ git push origin --delete content

To /home/sujee/Git/Ich.git

- [deleted] content

$ git push origin :menu

To /home/sujee/Git/Ich.git

- [deleted] menu

$ git push origin --delete more_content

To /home/sujee/Git/Ich.git

- [deleted] more_content

Wie man sieht, gibt es zwei verschiedene Möglichkeiten, Remote-Branches zu

löschen: Das wäre zum einen das git push Kommando mit dem Parameter

--delete und dem Namen des Remote-Branches und zum anderen kann man mit

git push auch mit einem Doppelpunkt vor dem Branch-Namen den Remote-Branch

löschen. Klarer und deutlicher ist vor allem die erste Variante. Auch dieser

Befehl lässt sich zusammenfassen, sodass man auch einfach folgenden Befehl

hätte ausführen können:

$ git push origin :menu :more_content :content

Folgender Befehl zeigt relevante Informationen von einem konfigurierten

Remote-Repository an:

$ git remote show origin

* Remote-Repository origin

URL zum Abholen: /home/sujee/Git/Ich.git

URL zum Versenden: /home/sujee/Git/Ich.git

Hauptbranch: master

Remote-Branch:

master gefolgt

Lokaler Branch konfiguriert für 'git pull':

master führt mit Remote-Branch master zusammen

Lokale Referenz konfiguriert für 'git push':

master versendet nach master (aktuell)

Wenn man einen Namen von einem Remote-Repository lokal

ändern möchte, kann man auch folgenden Befehl ausführen:

$ git remote rename er jemand

In diesem Fall wird dann der Name von er auf jemand geändert.

Remote-Repositorys kann man auch einfach wieder entfernen:

$ git remote rm jemand

Der Befehl liefert im Erfolgsfall keine Ausgabe. An diesem Punkt ist wichtig zu

wissen, dass nur die Verknüpfung im lokalen Repository gelöscht wird. Auf dem

entfernt liegenden Server sind weiterhin die Daten vorhanden, sofern diese

nicht schon vorher gelöscht worden sind.

Zum Schluss muss man nur noch das korrekte Arbeiten mit Remote-Branches

verstehen. Nach der vorangegangenen Aufräumaktion sind noch zwei

Remote-Repositorys übrig: origin und upstream. Auf origin befindet

sich nur noch der Branch master, auf upstream befinden sich noch alle

vier Branches, wobei dort master noch nicht auf dem aktuellen Stand ist.

Um master auch auf dem Remote-Repository namens upstream zu pushen:

$ git push upstream

Zähle Objekte: 3, Fertig.

Delta compression using up to 4 threads.

Komprimiere Objekte: 100% (3/3), Fertig.

Schreibe Objekte: 100% (3/3), 408 bytes | 0 bytes/s, Fertig.

Total 3 (delta 1), reused 0 (delta 0)

To /home/sujee/Git/Webseite-mit-Git.git

27bf2ae..59b89eb master -> master

Da kein Branch-Name angegeben wurde, wird der Branch gepusht, auf dem man

sich gerade befindet.

Jetzt steht nur noch an, dass man einen bestimmten Branch von upstream lokal

auschecken möchte. Die Remote-Branches folgen einem Muster, nämlich

<Remote>/<Branch-Name>. Wenn man also den Branch content auschecken

möchte, reicht es folgenden Befehl auszuführen:

$ git checkout upstream/content

Note: checking out 'upstream/content'.

You are in 'detached HEAD' state. You can look around, make experimental

changes and commit them, and you can discard any commits you make in this

state without impacting any branches by performing another checkout.

If you want to create a new branch to retain commits you create, you may

do so (now or later) by using -b with the checkout command again. Example:

git checkout -b new_branch_name

HEAD ist jetzt bei e39da6e... Lorem-Ipsum Fülltext hinzugefügt.

Das Problem hier ist, dass man in einem anderen Zustand landet, der sich

detached HEAD nennt. Wie der Text schon aussagt, ist es ein Zustand, in dem

man zwar Commits machen kann, allerdings sind diese keinem Branch zugeordnet.

Dies wird deutlich, wenn man git branch ausführt:

$ git branch

* (losgelöst von upstream/content)

master

Der Zustand ist allerdings weniger problematisch, da man sich einfach einen

neuen Branch anlegen kann, basierend auf dem Branch upstream/content:

$ git checkout -b content

Zu neuem Branch 'content' gewechselt

So ist man nun wieder auf einem normalen Branch in einem normalen Zustand. Wenn

man nun die Änderungen von einem Remote-Branch auch lokal haben möchte, kann

man diese mit git pull herunterladen. Der Pull-Befehl ist das Gegenstück vom

Push-Befehl.

$ git pull

There is no tracking information for the current branch.

Please specify which branch you want to merge with.

See git-pull(1) for details

git pull <remote> <branch>

If you wish to set tracking information for this branch you can do so with:

git branch --set-upstream-to=<remote>/<branch> content

Wie auch beim ersten Push-Befehl fehlt dem lokalen Branch die Verknüpfung,

woher die Änderungen heruntergeladen werden sollen. Wenn man nur einmalig die

Änderungen von upstream/content holen möchte, reicht es,

git pull upstream content auszuführen. Wenn man hingegen häufiger aus

demselben Branch vom selben Repository pullen möchte, dann bietet sich die oben

aufgeführte zweite Variante an.

Fazit

In diesem Teil der Artikel-Reihe zu Git wurde erläutert, was das Rebasen ist,

wie es geht und warum man es nutzt. Weiterhin kann man jetzt mit

Remote-Repositorys arbeiten und zwischen verschiedenen Remote-Repositorys

pullen und pushen.

Links

[1] http://www.freiesmagazin.de/freiesMagazin-2015-01

[2] https://github.com

[3] https://bitbucket.org/

| Autoreninformation |

| Sujeevan Vijayakumaran (Webseite)

nutzt seit drei Jahren Git als Versionsverwaltung nicht

nur zur Software-Entwicklung, sondern auch für das Schreiben von Artikeln.

|

Beitrag teilen Beitrag kommentieren

Zum Inhaltsverzeichnis

von Jens Dörpinghaus

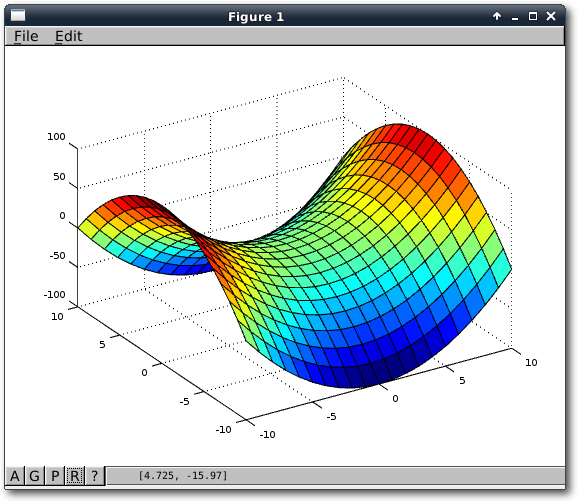

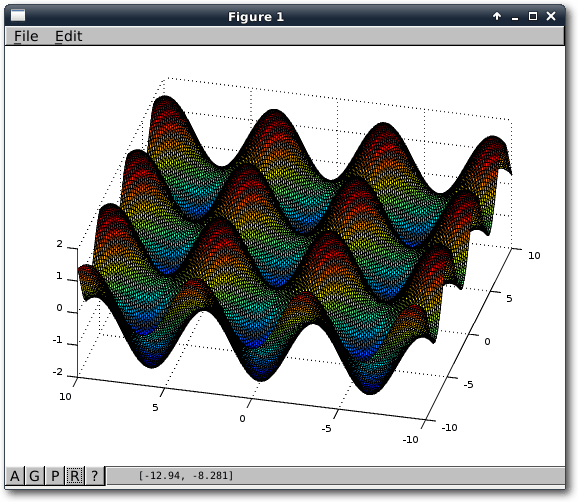

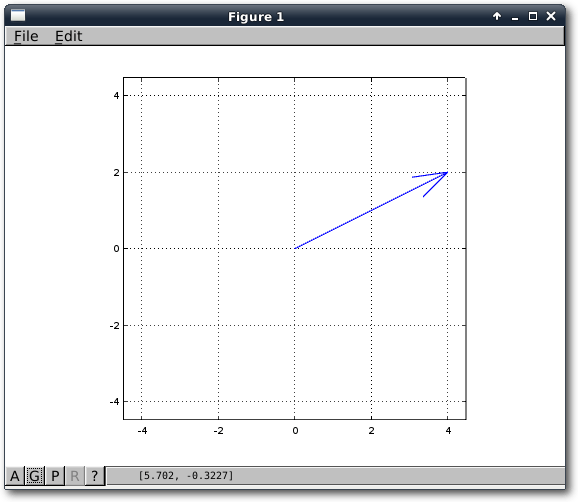

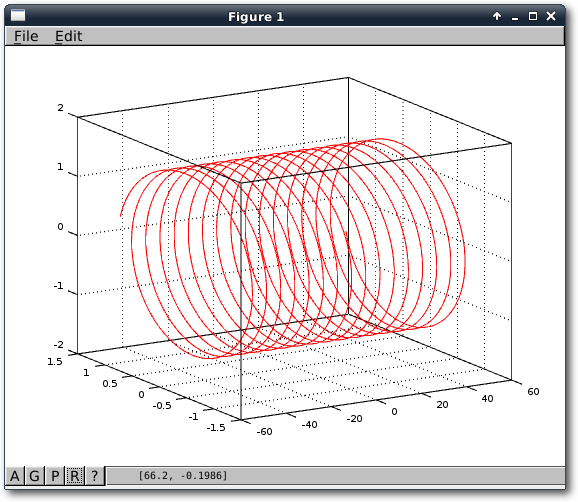

Nachdem im ersten Teil die Grundfunktionen von Octave (siehe freiesMagazin

12/2014 [1]) beschrieben wurden,

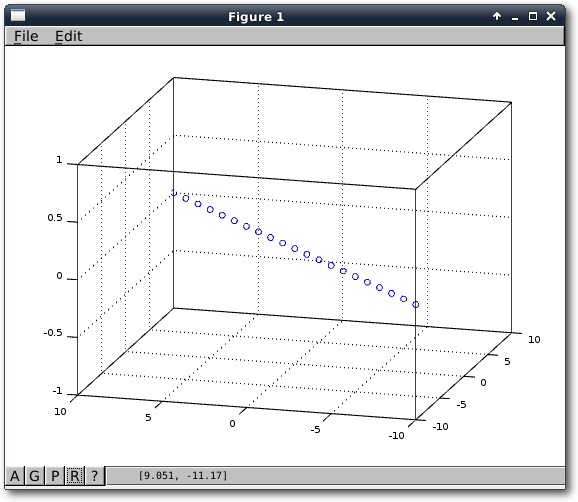

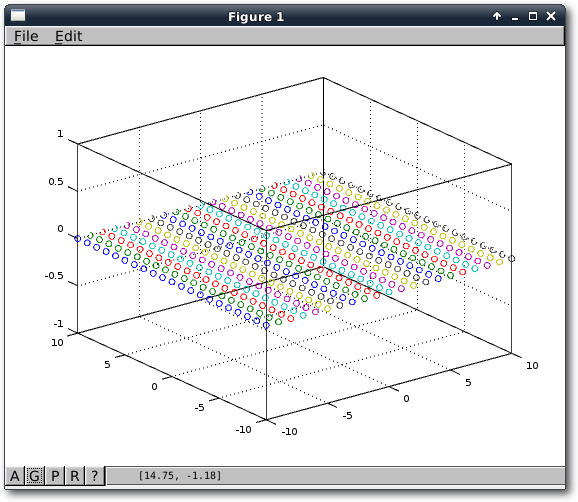

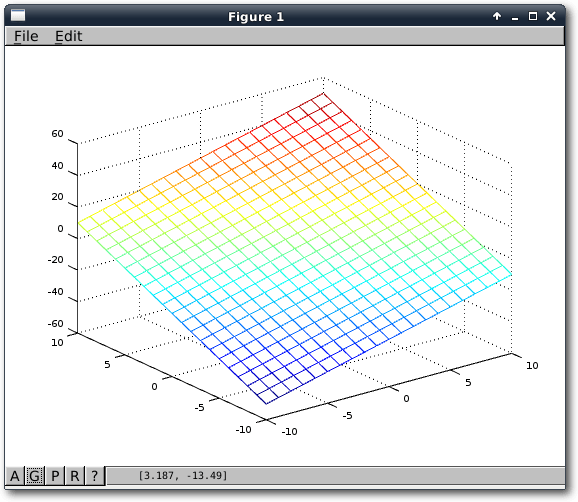

geht es nun direkt mit praktischen Anwendungen weiter: Der Schwerpunkt liegt in

diesem Teil auf Funktionen und dem Plotten von Graphen.

Beides sind Bereiche, die auch in der Schule schon von Nutzen sein können,

spätestens aber in einer Ausbildung oder einem Studium mit

naturwissenschaftlichem oder mathematischen Bezug wichtig sind.

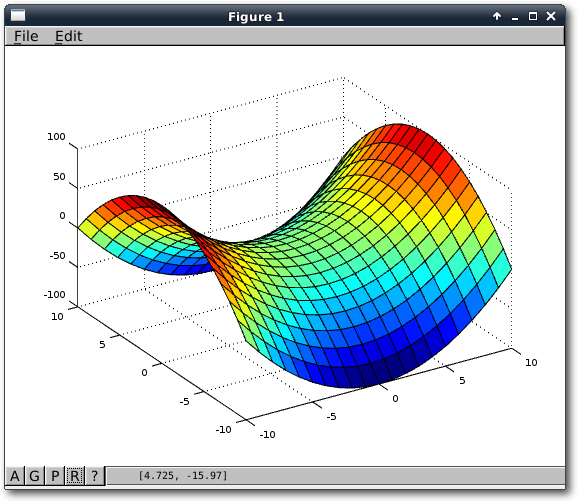

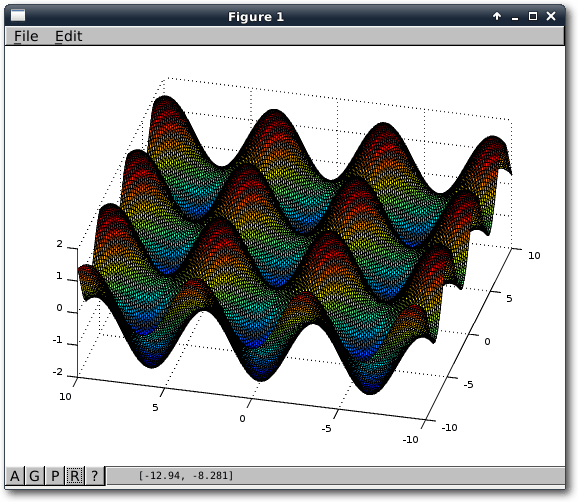

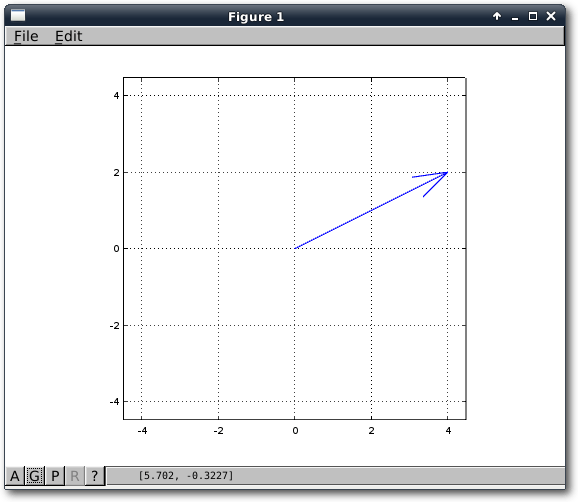

Funktionen und Grafiken

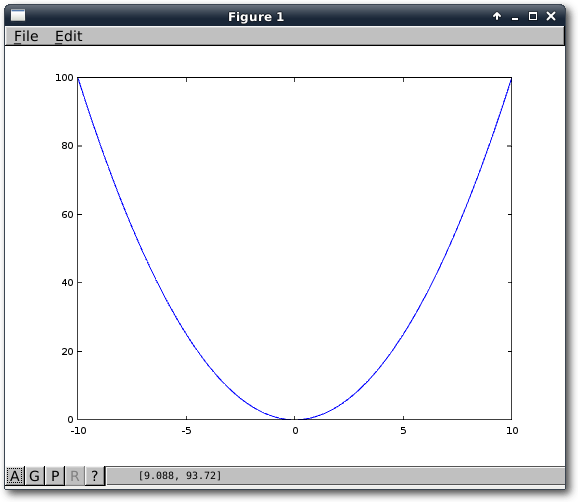

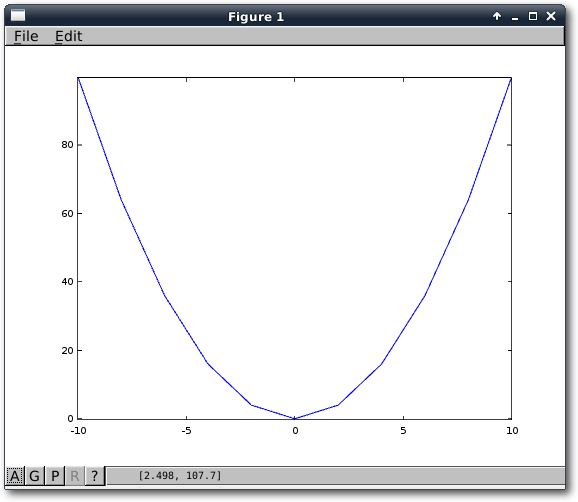

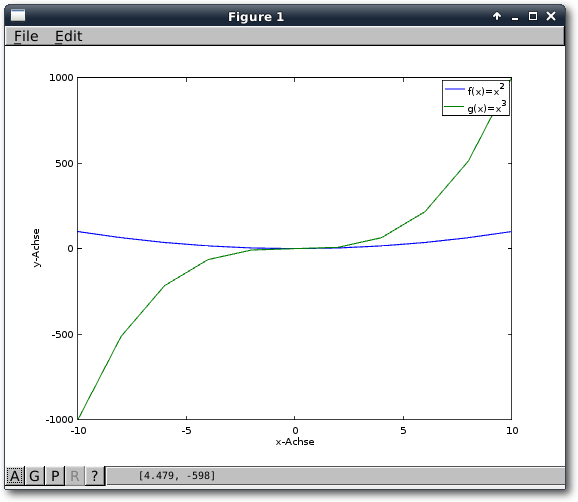

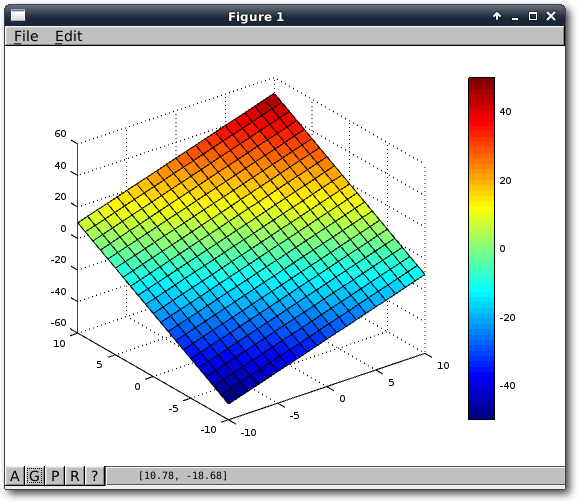

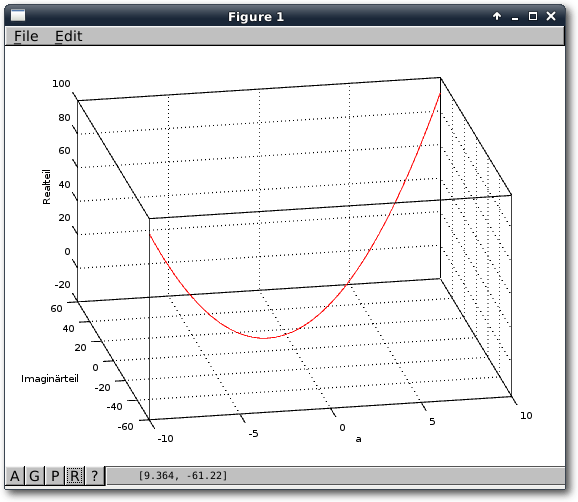

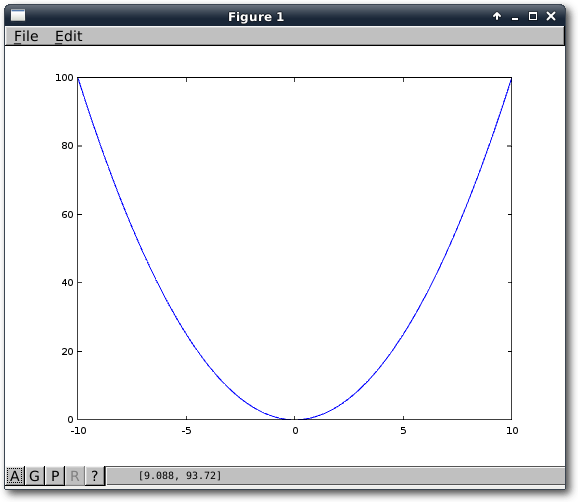

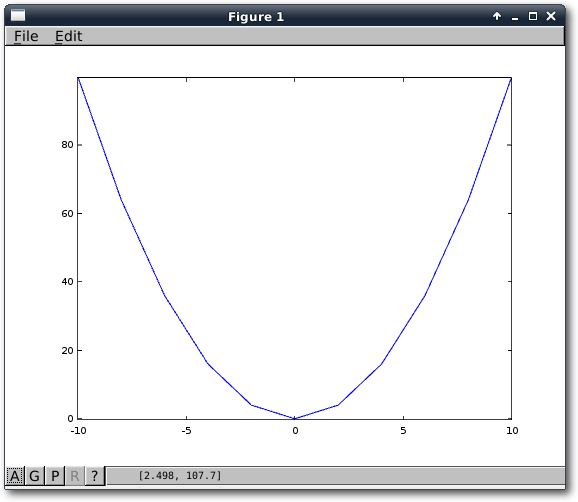

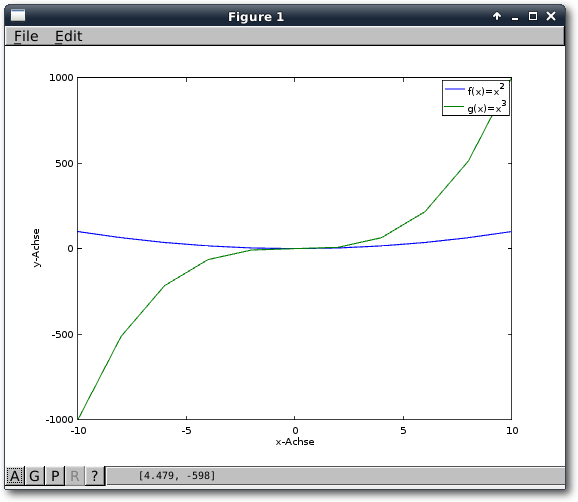

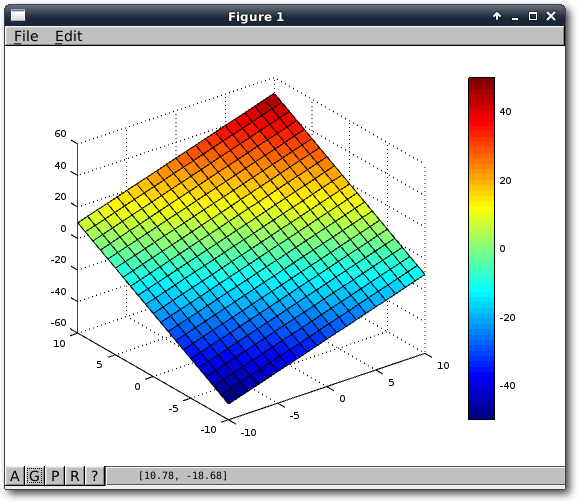

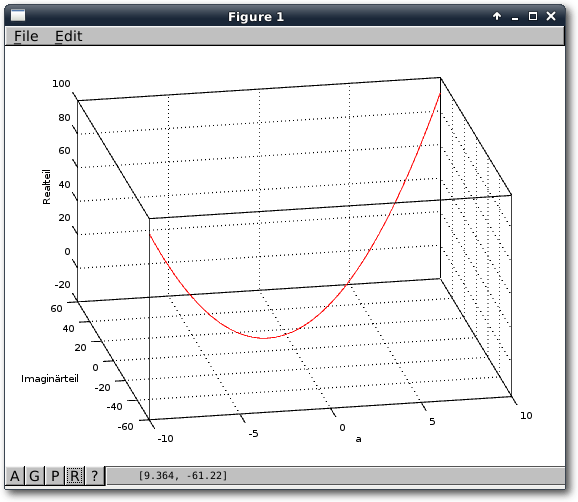

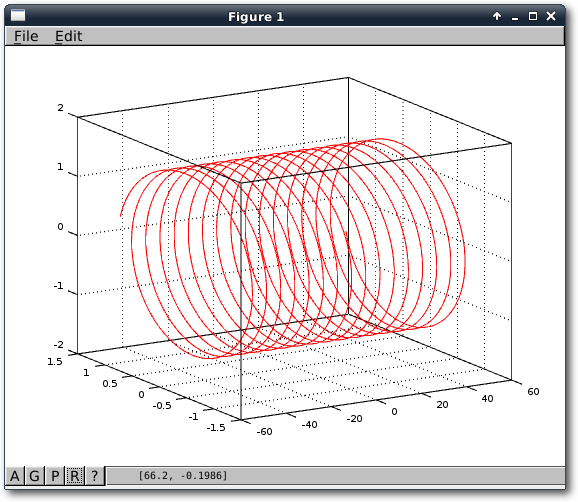

Als erstes Beispiel, um den Umgang mit Funktionen zu lernen, soll ein normaler

Funktionsgraph geplottet werden. Man legt dazu eine Funktion in Octave an – die